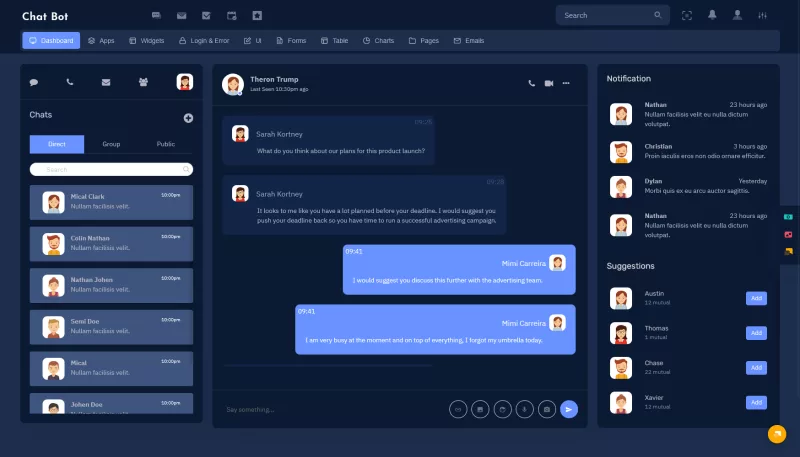

Giới Thiệu AI Coding Đỉnh Cao: Xây Dựng Ứng Dụng Đa Màn Hình Với AI Voice Assistant

Chào mừng bạn đến với vibecoding.vin, nơi chúng ta cùng khám phá những công nghệ đột phá và ứng dụng thực tế. Trong bối cảnh công nghệ AI đang phát triển vượt bậc, việc tích hợp các tính năng thông minh vào ứng dụng đã trở thành một yêu cầu thiết yếu. Bài viết này sẽ đi sâu vào việc xây dựng ứng dụng đa màn hình với khả năng tương tác bằng giọng nói, tập trung vào AI voice assistant. Chúng ta sẽ khám phá cách kết hợp sức mạnh của AI để tạo ra trải nghiệm người dùng mượt mà, trực quan và hiệu quả trên nhiều giao diện khác nhau.

AI Voice Assistant Là Gì Và Tại Sao Lại Quan Trọng?

AI voice assistant, hay trợ lý giọng nói AI, là một hệ thống phần mềm có khả năng hiểu và phản hồi lại các lệnh nói của con người. Nó sử dụng công nghệ nhận dạng giọng nói (Speech-to-Text - STT) để chuyển đổi âm thanh thành văn bản, xử lý ngôn ngữ tự nhiên (Natural Language Processing - NLP) để hiểu ý nghĩa của câu lệnh, và tổng hợp giọng nói (Text-to-Speech - TTS) để phản hồi bằng giọng nói. Các ví dụ điển hình bao gồm Siri, Google Assistant, Alexa và Cortana.

Sự quan trọng của AI voice assistant ngày càng tăng lên trong kỷ nguyên số. Nó không chỉ đơn thuần là một tiện ích mà còn là một giao diện tương tác tự nhiên, giúp người dùng thực hiện các tác vụ một cách dễ dàng và nhanh chóng mà không cần đến bàn phím hay màn hình. Điều này đặc biệt hữu ích trong các tình huống rảnh tay (hands-free), như khi lái xe, nấu ăn, hoặc cho những người có hạn chế về thể chất. AI voice assistant cải thiện đáng kể khả năng tiếp cận và trải nghiệm người dùng, mở ra cánh cửa cho những ứng dụng sáng tạo và tiện lợi hơn.

Trong một ứng dụng đa màn hình, việc tích hợp AI voice assistant mang lại lợi ích kép. Thứ nhất, nó đảm bảo tính nhất quán trong trải nghiệm người dùng trên các thiết bị khác nhau, từ điện thoại di động, máy tính bảng đến màn hình thông minh hay thậm chí là thiết bị IoT. Người dùng có thể bắt đầu một tác vụ trên thiết bị này và tiếp tục trên thiết bị khác chỉ bằng giọng nói. Thứ hai, nó giúp đơn giản hóa các thao tác phức tạp trên màn hình nhỏ hoặc trong môi trường mà việc nhập liệu thủ công là bất tiện. Việc triển khai một AI voice assistant hiệu quả không chỉ là xu hướng mà còn là yếu tố then chốt để tạo ra sự khác biệt cho ứng dụng của bạn.

Kiến Trúc Tổng Quan Cho Ứng Dụng Đa Màn Hình Với AI Voice Assistant

Để xây dựng một ứng dụng đa màn hình tích hợp AI voice assistant, chúng ta cần một kiến trúc mạnh mẽ và linh hoạt. Kiến trúc này thường bao gồm các thành phần chính sau:

- Giao diện người dùng (User Interface - UI) và Lớp Trình bày (Presentation Layer): Đây là phần mà người dùng tương tác trực tiếp, bao gồm các màn hình trên điện thoại, web, hoặc các thiết bị thông minh khác. Lớp này chịu trách nhiệm hiển thị thông tin và thu thập input từ người dùng, bao gồm cả input giọng nói.

- Module Nhận Dạng Giọng Nói (Speech-to-Text - STT): Đây là thành phần cốt lõi của AI voice assistant, có nhiệm vụ chuyển đổi lời nói thành văn bản. Các dịch vụ cloud AI như Google Cloud Speech-to-Text, AWS Transcribe, hoặc Azure Speech Service thường được sử dụng vì độ chính xác cao và khả năng hỗ trợ nhiều ngôn ngữ.

- Module Xử Lý Ngôn Ngữ Tự Nhiên (Natural Language Processing - NLP): Sau khi có văn bản từ STT, module NLP sẽ phân tích ý định (intent) và các thực thể (entities) trong câu nói của người dùng. Ví dụ, nếu người dùng nói "Tìm kiếm nhà hàng Ý gần đây", NLP sẽ xác định intent là "tìm kiếm" và entity là "nhà hàng Ý" và "gần đây". Các framework như Dialogflow, Rasa, hoặc thư viện spaCy có thể được sử dụng ở đây.

- Logic Ứng Dụng (Application Logic/Business Logic): Dựa trên intent và entities được xác định bởi NLP, logic ứng dụng sẽ thực hiện các hành động tương ứng. Điều này có thể bao gồm truy vấn cơ sở dữ liệu, gọi API bên ngoài, hoặc cập nhật trạng thái ứng dụng.

- Module Tổng Hợp Giọng Nói (Text-to-Speech - TTS): Sau khi logic ứng dụng xử lý và có kết quả, module TTS sẽ chuyển đổi phản hồi dạng văn bản thành giọng nói để trả lời người dùng. Tương tự như STT, các dịch vụ cloud AI cũng cung cấp TTS chất lượng cao.

- Lớp Đồng Bộ Hóa Trạng Thái (State Synchronization Layer): Trong ứng dụng đa màn hình, việc đồng bộ trạng thái giữa các thiết bị là rất quan trọng. Ví dụ, nếu người dùng bắt đầu một tác vụ trên điện thoại bằng giọng nói, trạng thái của tác vụ đó cần được phản ánh trên màn hình thông minh. Các công nghệ như WebSockets, Firebase Realtime Database, hoặc GraphQL subscriptions có thể được sử dụng.

Sự kết hợp hài hòa của các thành phần này tạo nên một hệ thống mạnh mẽ, có khả năng phản ứng linh hoạt với giọng nói của người dùng trên mọi nền tảng.

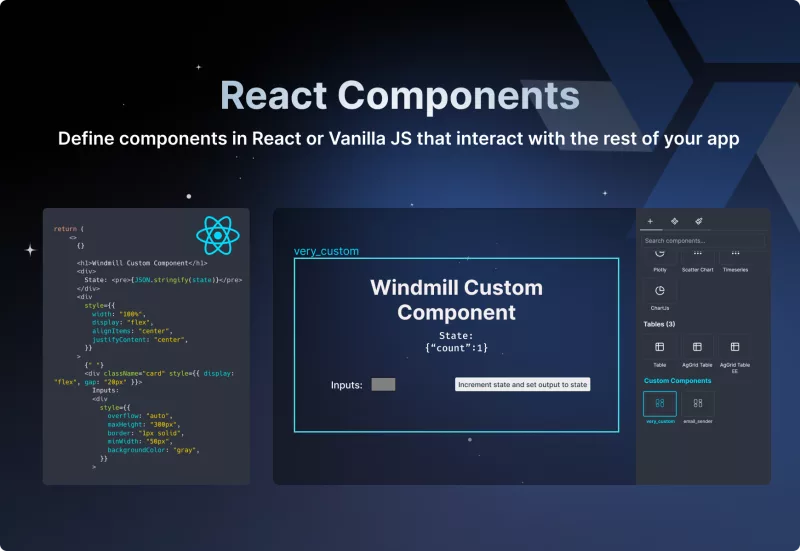

Hướng Dẫn Thực Hành: Xây Dựng AI Voice Assistant Đơn Giản Với React và Google Cloud

Để minh họa, chúng ta sẽ xây dựng một phần cốt lõi của AI voice assistant sử dụng React cho frontend và tích hợp với Google Cloud Speech-to-Text và Dialogflow cho phần xử lý giọng nói và NLP. Đây là một ví dụ đơn giản nhưng đủ để bạn hình dung được quy trình.

Bước 1: Thiết lập Dự án React

Khởi tạo một dự án React mới:

npx create-react-app ai-voice-app

cd ai-voice-app

npm startBước 2: Tích hợp Google Cloud Speech-to-Text (STT)

Chúng ta sẽ sử dụng thư viện @google-cloud/speech. Tuy nhiên, việc gọi trực tiếp từ frontend có thể gặp vấn đề về bảo mật và CORS. Cách tiếp cận tốt hơn là tạo một API backend trung gian. Giả sử bạn đã có một API endpoint (chẳng hạn /api/speech-to-text) trên server của mình, nơi xử lý việc gọi Google Cloud STT.

Trong React, chúng ta sẽ sử dụng Web Audio API để thu âm giọng nói và gửi lên backend.

// src/components/VoiceInput.js

import React, { useState, useRef } from 'react';

import axios from 'axios';

const VoiceInput = ({ onTranscript }) => {

const [isRecording, setIsRecording] = useState(false);

const mediaRecorderRef = useRef(null);

const audioChunksRef = useRef([]);

const startRecording = async () => {

const stream = await navigator.mediaDevices.getUserMedia({ audio: true });

mediaRecorderRef.current = new MediaRecorder(stream);

mediaRecorderRef.current.ondataavailable = (event) => {

audioChunksRef.current.push(event.data);

};

mediaRecorderRef.current.onstop = async () => {

const audioBlob = new Blob(audioChunksRef.current, { type: 'audio/webm' });

audioChunksRef.current = [];

const formData = new FormData();

formData.append('audio', audioBlob, 'audio.webm');

try {

// Gửi blob âm thanh đến backend để xử lý STT

const response = await axios.post('/api/speech-to-text', formData, {

headers: { 'Content-Type': 'multipart/form-data' }

});

onTranscript(response.data.transcript);

} catch (error) {

console.error('Error during speech-to-text:', error);

}

};

mediaRecorderRef.current.start();

setIsRecording(true);

};

const stopRecording = () => {

mediaRecorderRef.current.stop();

setIsRecording(false);

};

return (

<div>

<button onClick={isRecording ? stopRecording : startRecording}>

{isRecording ? 'Stop Recording' : 'Start Recording'}

</button>

</div>

);

};

export default VoiceInput;Bạn sẽ cần một backend server (Node.js, Python, v.v.) để xử lý file âm thanh và gọi Google Cloud STT. Ví dụ Node.js:

// server.js (ví dụ)

const express = require('express');

const { SpeechClient } = require('@google-cloud/speech');

const multer = require('multer');

const upload = multer({ storage: multer.memoryStorage() }); // Lưu file vào bộ nhớ

const app = express();

const client = new SpeechClient();

app.post('/api/speech-to-text', upload.single('audio'), async (req, res) => {

if (!req.file) {

return res.status(400).send('No audio file uploaded.');

}

const audioBytes = req.file.buffer.toString('base64');

const request = {

audio: { content: audioBytes },

config: {

encoding: 'WEBM_OPUS', // Hoặc FLAC, LINEAR16 tùy thuộc vào định dạng ghi âm

sampleRateHertz: 48000, // Hoặc 16000, 44100 tùy thuộc vào thiết bị ghi âm

languageCode: 'vi-VN', // Hoặc 'en-US'

},

};

try {

const [response] = await client.recognize(request);

const transcript = response.results

.map(result => result.alternatives[0].transcript)

.join('\n');

res.json({ transcript });

} catch (error) {

console.error('Google Cloud STT Error:', error);

res.status(500).json({ error: 'Failed to process speech.' });

}

});

app.listen(3001, () => console.log('Backend listening on port 3001'));Bạn cần cấu hình Google Cloud Project và xác thực tài khoản để sử dụng Speech-to-Text API.

Bước 3: Tích hợp Dialogflow (NLP) để xử lý ý định

Sau khi có transcript từ STT, chúng ta sẽ gửi nó đến Dialogflow để xác định ý định và thực thể. Bạn cần tạo một Dialogflow agent, định nghĩa các intents và training phrases.

Cũng tương tự như STT, việc gọi Dialogflow từ frontend cần một backend trung gian để quản lý API key và tránh vấn đề CORS.

// server.js (tiếp tục)

const dialogflow = require('@google-cloud/dialogflow');

const sessionClient = new dialogflow.SessionsClient();

const projectId = 'your-gcp-project-id'; // Thay bằng ID dự án Google Cloud của bạn

app.post('/api/dialogflow', async (req, res) => {

const { text, sessionId } = req.body;

const sessionPath = sessionClient.projectAgentSessionPath(projectId, sessionId);

const request = {

session: sessionPath,

queryInput: {

text: {

text: text,

languageCode: 'vi-VN', // Hoặc 'en-US'

},

},

};

try {

const [response] = await sessionClient.detectIntent(request);

res.json({

fulfillmentText: response.queryResult.fulfillmentText,

intent: response.queryResult.intent ? response.queryResult.intent.displayName : 'None',

parameters: response.queryResult.parameters.fields,

});

} catch (error) {

console.error('Dialogflow Error:', error);

res.status(500).json({ error: 'Failed to process intent.' });

}

});Trong React component:

// src/components/VoiceInput.js (tiếp tục)

// ...

const VoiceInput = ({ onTranscript, onResponse }) => {

// ...

const processTranscript = async (transcript) => {

onTranscript(transcript);

try {

// Gửi transcript đến backend để xử lý Dialogflow

const response = await axios.post('/api/dialogflow', {

text: transcript,

sessionId: 'unique-user-session-id' // Tạo một ID duy nhất cho mỗi phiên

});

onResponse(response.data.fulfillmentText); // Phản hồi từ Dialogflow

} catch (error) {

console.error('Error during Dialogflow processing:', error);

}

};

// Thay thế onTranscript(response.data.transcript); trong onstop bằng processTranscript

// mediaRecorderRef.current.onstop = async () => {

// ...

// const response = await axios.post('/api/speech-to-text', formData, { ... });

// processTranscript(response.data.transcript);

// };

// ...

};Bước 4: Tích hợp Text-to-Speech (TTS) để phản hồi

Khi có phản hồi từ Dialogflow, chúng ta sử dụng Text-to-Speech để đọc lại cho người dùng. Bạn có thể sử dụng Web Speech API có sẵn trong trình duyệt hoặc gọi một dịch vụ TTS backend (như Google Cloud Text-to-Speech).

Sử dụng Web Speech API (đơn giản hơn cho demo):

// src/components/VoiceInput.js (tiếp tục)

// ...

const VoiceInput = ({ onTranscript, onResponse }) => {

// ...

const speakResponse = (text) => {

const utterance = new SpeechSynthesisUtterance(text);

utterance.lang = 'vi-VN'; // Hoặc 'en-US'

window.speechSynthesis.speak(utterance);

};

// Gọi speakResponse khi có phản hồi từ Dialogflow

// const processTranscript = async (transcript) => {

// ...

// const response = await axios.post('/api/dialogflow', { ... });

// onResponse(response.data.fulfillmentText);

// speakResponse(response.data.fulfillmentText); // Thêm dòng này

// ...

// };

// ...

};Đây là một ví dụ cơ bản. Ứng dụng thực tế sẽ cần quản lý trạng thái phức tạp hơn, xử lý lỗi, tối ưu hóa hiệu suất và đồng bộ hóa trên nhiều màn hình.

Tips và Best Practices Khi Phát Triển AI Voice Assistant

Khi xây dựng AI voice assistant, có một số kinh nghiệm thực tế có thể giúp bạn tạo ra một sản phẩm tốt hơn:

- Ưu tiên Trải Nghiệm Người Dùng (UX): Giao diện giọng nói cần phải trực quan và dễ sử dụng. Cung cấp phản hồi rõ ràng khi người dùng nói, khi hệ thống đang xử lý, và khi có kết quả. Tránh những phản hồi quá dài dòng hoặc không liên quan.

- Xử lý Lỗi và Trường hợp Ngoại lệ: Không phải lúc nào giọng nói cũng được nhận dạng chính xác, hoặc ý định của người dùng cũng rõ ràng. Hãy chuẩn bị các thông báo lỗi thân thiện và gợi ý để người dùng có thể thử lại hoặc điều chỉnh câu lệnh. Ví dụ: "Xin lỗi, tôi không hiểu. Bạn có thể nói rõ hơn không?"

- Tối ưu hóa Độ trễ (Latency): Độ trễ là yếu tố cực kỳ quan trọng đối với trải nghiệm giọng nói. Người dùng mong đợi phản hồi gần như ngay lập tức. Hãy tối ưu hóa pipeline của bạn, từ ghi âm, STT, NLP, đến TTS, để giảm thiểu độ trễ. Sử dụng các dịch vụ cloud có độ trễ thấp và cân nhắc xử lý một số phần cục bộ nếu có thể.

- Hỗ trợ Ngữ cảnh và Cá nhân hóa: Một AI voice assistant hiệu quả cần có khả năng ghi nhớ ngữ cảnh của cuộc trò chuyện và cá nhân hóa phản hồi dựa trên lịch sử tương tác hoặc thông tin người dùng. Điều này giúp cuộc trò chuyện tự nhiên và hữu ích hơn.

- Phát triển theo phương pháp lặp (Iterative Development): Bắt đầu với một tập hợp tính năng cốt lõi và dần dần mở rộng. Thu thập phản hồi từ người dùng thực để liên tục cải thiện độ chính xác của STT, NLP và chất lượng TTS.

- Bảo mật Dữ liệu Giọng nói: Đảm bảo rằng dữ liệu giọng nói của người dùng được bảo mật và tuân thủ các quy định về quyền riêng tư (GDPR, CCPA). Nếu bạn lưu trữ dữ liệu giọng nói, hãy mã hóa và chỉ giữ lại trong thời gian cần thiết.

- Kiểm tra trên Nhiều Thiết Bị và Môi trường: Giọng nói có thể bị ảnh hưởng bởi tiếng ồn môi trường, chất lượng microphone và accent của người nói. Hãy kiểm tra AI voice assistant của bạn trên nhiều loại thiết bị, trong các môi trường khác nhau để đảm bảo hiệu suất ổn định.

So Sánh Các Nền Tảng AI Voice Assistant Phổ Biến

Khi phát triển AI voice assistant, việc lựa chọn nền tảng phù hợp là rất quan trọng. Dưới đây là so sánh một số nền tảng phổ biến:

- Google Cloud AI (Speech-to-Text, Dialogflow, Text-to-Speech):

- Ưu điểm: Độ chính xác cao, hỗ trợ nhiều ngôn ngữ, tích hợp tốt với các sản phẩm Google khác. Dialogflow cung cấp giao diện trực quan để xây dựng agent NLP. TTS có nhiều giọng nói tự nhiên.

- Nhược điểm: Chi phí có thể tăng lên với lượng sử dụng lớn. Cần kiến thức về Google Cloud Platform.

- Phù hợp cho: Các dự án yêu cầu độ chính xác cao, khả năng mở rộng lớn và tích hợp sâu với hệ sinh thái Google.

- Amazon Web Services (AWS) AI (Transcribe, Lex, Polly):

- Ưu điểm: Tích hợp chặt chẽ với hệ sinh thái AWS, cung cấp các dịch vụ mạnh mẽ từ STT (Transcribe), NLP (Lex) đến TTS (Polly). Lex cho phép xây dựng chatbot và voicebot dễ dàng.

- Nhược điểm: Có thể phức tạp để cấu hình cho người mới bắt đầu với AWS.

- Phù hợp cho: Các doanh nghiệp đã sử dụng AWS hoặc muốn xây dựng giải pháp AI toàn diện trên một nền tảng cloud duy nhất.

- Microsoft Azure AI (Speech Service, Bot Framework Composer):

- Ưu điểm: Speech Service cung cấp STT, TTS và dịch thuật. Bot Framework Composer giúp xây dựng các bot đàm thoại phức tạp. Hỗ trợ nhiều ngôn ngữ và giọng nói tùy chỉnh.

- Nhược điểm: Cần kiến thức về Azure.

- Phù hợp cho: Các tổ chức sử dụng công nghệ Microsoft hoặc cần các tính năng AI mạnh mẽ cho các ứng dụng doanh nghiệp.

- Rasa (Open-source NLP):

- Ưu điểm: Mã nguồn mở, cho phép kiểm soát hoàn toàn dữ liệu và mô hình. Có thể triển khai on-premise hoặc trên cloud. Cộng đồng lớn và linh hoạt.

- Nhược điểm: Yêu cầu kiến thức chuyên sâu về NLP và Machine Learning để cấu hình và tối ưu. Không bao gồm STT/TTS.

- Phù hợp cho: Các dự án cần tùy chỉnh cao, bảo mật dữ liệu tuyệt đối hoặc muốn tránh phụ thuộc vào nhà cung cấp cloud.

Việc lựa chọn nền tảng phụ thuộc vào yêu cầu cụ thể của dự án, ngân sách, khả năng kỹ thuật của đội ngũ và mức độ tùy chỉnh mong muốn.

Các Lưu Ý Quan Trọng

- Bắt đầu với một phạm vi hẹp: Đừng cố gắng giải quyết tất cả các trường hợp sử dụng cùng một lúc. Hãy tập trung vào một vài kịch bản cốt lõi mà AI voice assistant có thể giải quyết hiệu quả nhất.

- Đừng bỏ qua vấn đề về quyền riêng tư: Luôn minh bạch với người dùng về cách dữ liệu giọng nói của họ được thu thập, xử lý và lưu trữ. Cung cấp các tùy chọn để người dùng kiểm soát dữ liệu của họ.

- Kiểm tra hiệu suất trên các thiết bị khác nhau: Một ứng dụng đa màn hình cần hoạt động mượt mà trên nhiều kích thước màn hình, độ phân giải và khả năng xử lý khác nhau. Đảm bảo rằng AI voice assistant cũng tương thích và hoạt động tốt trên tất cả các thiết bị.

- Tối ưu hóa cho các ngôn ngữ khác nhau: Nếu ứng dụng của bạn hướng đến người dùng toàn cầu, hãy đảm bảo rằng AI voice assistant hỗ trợ nhiều ngôn ngữ và có khả năng xử lý các giọng điệu khác nhau.

- Cân nhắc chi phí: Các dịch vụ AI cloud thường tính phí dựa trên lượng sử dụng. Hãy theo dõi và ước tính chi phí để tránh bất ngờ.

- Luôn cập nhật công nghệ: Lĩnh vực AI phát triển rất nhanh. Hãy theo dõi các bản cập nhật từ các nhà cung cấp dịch vụ AI và các nghiên cứu mới để ứng dụng của bạn không bị lạc hậu.

- Cung cấp các phương thức nhập liệu thay thế: Mặc dù AI voice assistant rất tiện lợi, nhưng không phải lúc nào người dùng cũng muốn hoặc có thể sử dụng giọng nói. Luôn cung cấp tùy chọn nhập liệu bằng văn bản hoặc giao diện cảm ứng.

Câu Hỏi Thường Gặp

Làm thế nào để đảm bảo AI voice assistant hiểu được các giọng điệu và tiếng lóng khác nhau?

Để AI voice assistant có thể hiểu các giọng điệu và tiếng lóng khác nhau, bạn cần huấn luyện mô hình NLP với một tập dữ liệu đa dạng, bao gồm các biến thể ngôn ngữ đó. Các dịch vụ AI cloud lớn thường đã được huấn luyện trên lượng lớn dữ liệu, nhưng bạn có thể tinh chỉnh (fine-tune) bằng cách thêm các "training phrases" cụ thể vào Dialogflow hoặc tương tự.

Tôi có cần một backend riêng để tích hợp AI voice assistant không?

Thường thì có. Mặc dù một số API STT/TTS có thể gọi trực tiếp từ frontend, nhưng việc sử dụng backend giúp quản lý API keys an toàn, xử lý logic phức tạp hơn, và trung gian cho các dịch vụ AI cloud, đặc biệt khi tích hợp NLP như Dialogflow hoặc Lex.

Làm thế nào để đồng bộ trạng thái của cuộc trò chuyện giọng nói trên nhiều màn hình?

Bạn có thể sử dụng các công nghệ thời gian thực như WebSockets hoặc Firebase Realtime Database. Khi người dùng tương tác bằng giọng nói trên một thiết bị, trạng thái cuộc trò chuyện và các phản hồi liên quan sẽ được gửi đến một dịch vụ trung tâm, sau đó được phát tới tất cả các màn hình liên quan đã đăng ký để hiển thị thông tin cập nhật.

AI voice assistant có thể hoạt động offline không?

Hầu hết các AI voice assistant mạnh mẽ hiện nay đều yêu cầu kết nối internet để truy cập các dịch vụ STT, NLP và TTS trên cloud. Tuy nhiên, một số thư viện hoặc mô hình AI nhỏ có thể chạy cục bộ trên thiết bị (on-device) cho các tác vụ đơn giản, nhưng độ chính xác và khả năng xử lý thường bị hạn chế.

Kết Luận

Xây dựng một ứng dụng đa màn hình với AI voice assistant không chỉ là một thách thức công nghệ mà còn là cơ hội để tạo ra những trải nghiệm người dùng đột phá. Bằng cách kết hợp sức mạnh của nhận dạng giọng nói, xử lý ngôn ngữ tự nhiên và tổng hợp giọng nói, chúng ta có thể tạo ra các ứng dụng thông minh, trực quan và dễ tiếp cận hơn bao giờ hết. Hy vọng bài viết này đã cung cấp cho bạn cái nhìn tổng quan và những bước đi đầu tiên cần thiết để bắt đầu hành trình của mình trong lĩnh vực AI coding đầy hứa hẹn này.

Hãy tiếp tục theo dõi vibe coding để khám phá thêm nhiều dự án thực tế và kiến thức chuyên sâu về AI và phát triển phần mềm!