Giới Thiệu Tự Động Hóa Workflow Phát Triển Với AI Agent: Kết Nối API Đa Dịch Vụ, Mở Khóa Tiềm Năng Vibe Coding Không Giới Hạn

Trong thế giới phát triển phần mềm đang thay đổi thần tốc, việc tối ưu hóa quy trình làm việc không chỉ là một lợi thế mà còn là yếu tố sống còn. Chúng ta đang chứng kiến sự trỗi dậy mạnh mẽ của AI Agent, những thực thể phần mềm thông minh có khả năng tự động hóa các tác vụ phức tạp, từ phân tích yêu cầu đến triển khai mã. Đặc biệt, khía cạnh tích hợp API đa dịch vụ của các AI Agent này đang mở ra những chân trời mới, cho phép chúng ta kết nối và điều phối các công cụ, nền tảng khác nhau một cách liền mạch. Bài viết này sẽ giúp bạn hiểu rõ về AI Agent tích hợp API từ góc nhìn thực tế, khám phá cách chúng có thể biến đổi cách chúng ta lập trình và tạo ra một "vibe coding" không giới hạn.

Hãy cùng đi sâu vào cách mà AI Agent, thông qua khả năng kết nối API, không chỉ nâng cao hiệu suất mà còn giải phóng sự sáng tạo của các nhà phát triển. Chúng ta sẽ tìm hiểu về kiến trúc, các trường hợp sử dụng thực tế và những thách thức cần vượt qua để khai thác tối đa tiềm năng của công nghệ này.

AI Agent Tích Hợp API: Kiến Trúc và Sức Mạnh

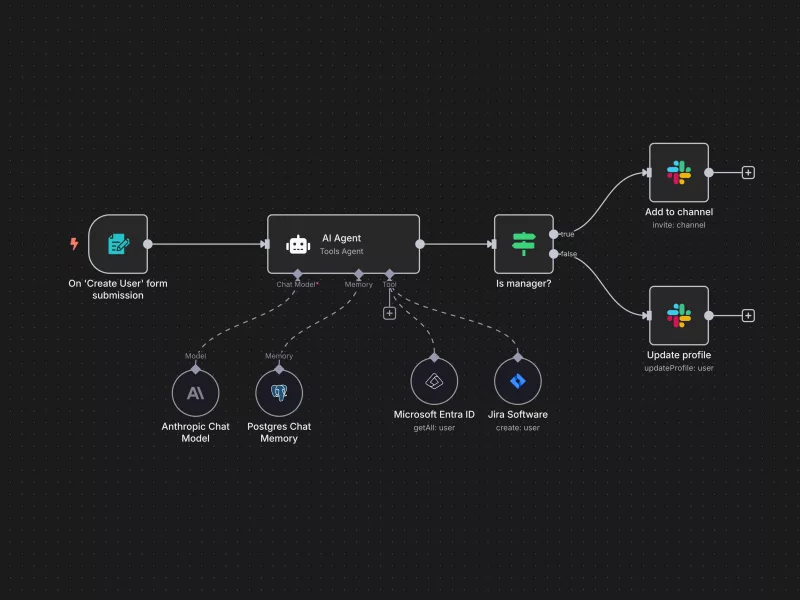

AI Agent là một hệ thống phần mềm có khả năng nhận thức môi trường, ra quyết định và thực hiện hành động để đạt được mục tiêu cụ thể. Điểm mạnh cốt lõi của một AI Agent hiện đại nằm ở khả năng tương tác với thế giới bên ngoài thông qua API (Application Programming Interface). API chính là cánh cổng giúp AI Agent giao tiếp với các hệ thống, dịch vụ và dữ liệu khác nhau, biến nó thành một "bộ não" trung tâm có khả năng điều phối một dàn nhạc công nghệ.

Kiến trúc của một AI Agent tích hợp API thường bao gồm các thành phần chính như:

- Core AI Model (Mô hình AI cốt lõi): Thường là một Large Language Model (LLM) như GPT-4, Claude, hoặc một mô hình học máy chuyên biệt khác. Đây là "bộ não" đưa ra các quyết định, lên kế hoạch và tạo ra các tác vụ.

- Tool/API Registry (Kho công cụ/API): Một danh sách các API mà AI Agent có thể truy cập, cùng với mô tả chức năng của từng API (thường ở định dạng OpenAPI/Swagger). Điều này giúp AI Agent hiểu được cách sử dụng các công cụ có sẵn.

- Planning & Reasoning Engine (Công cụ lập kế hoạch & suy luận): Thành phần này phân tích yêu cầu của người dùng, chia nhỏ thành các bước nhỏ hơn và quyết định API nào cần được gọi để hoàn thành từng bước.

- Execution Engine (Công cụ thực thi): Chịu trách nhiệm thực hiện các lệnh gọi API đã được lên kế hoạch và xử lý phản hồi.

- Memory Module (Mô-đun bộ nhớ): Lưu trữ lịch sử tương tác, trạng thái hiện tại và các thông tin liên quan để AI Agent có thể duy trì ngữ cảnh và học hỏi từ kinh nghiệm.

Sức mạnh của AI Agent tích hợp API nằm ở khả năng "xâu chuỗi" các API lại với nhau để giải quyết các vấn đề phức tạp. Thay vì chỉ gọi một API đơn lẻ, một AI Agent có thể:

- Phân tích yêu cầu.

- Tìm kiếm các API phù hợp trong kho công cụ.

- Tạo ra một chuỗi các lệnh gọi API logic.

- Thực thi chuỗi đó và xử lý các lỗi hoặc kết quả không mong muốn.

- Điều chỉnh kế hoạch dựa trên phản hồi để đạt được mục tiêu cuối cùng.

Điều này mở ra tiềm năng to lớn cho việc tự động hóa các workflow phức tạp trong phát triển phần mềm, từ việc lập kế hoạch dự án, tạo mã, kiểm thử, đến triển khai và giám sát. Một AI Agent tích hợp API không chỉ là một công cụ, mà là một cộng tác viên thông minh, giúp chúng ta tập trung vào những khía cạnh sáng tạo hơn của công việc.

Thực Hành Xây Dựng AI Agent Tích Hợp API Đa Dịch Vụ

Để minh họa cách xây dựng một AI Agent tích hợp API, chúng ta sẽ xem xét một ví dụ đơn giản: một AI Agent có khả năng lấy thông tin thời tiết, gửi email thông báo và tạo một mục trong lịch làm việc. Đây là một ví dụ cơ bản nhưng đủ để hình dung về sức mạnh của việc kết nối API.

Bước 1: Xác định các API cần tích hợp

Chúng ta sẽ cần các API sau:

- OpenWeatherMap API: Để lấy thông tin thời tiết.

- SendGrid API (hoặc tương tự): Để gửi email.

- Google Calendar API (hoặc tương tự): Để tạo sự kiện lịch.

Bước 2: Chuẩn bị mô tả API (Tool Definitions)

Mô tả API là cách để mô hình AI biết cách gọi các hàm. Chúng ta thường sử dụng định dạng JSON Schema hoặc định dạng tương tự để mô tả các hàm, tham số và giá trị trả về. Đây là ví dụ về cách một hàm lấy thời tiết có thể được mô tả:

{

"name": "get_current_weather",

"description": "Lấy thông tin thời tiết hiện tại cho một thành phố cụ thể.",

"parameters": {

"type": "object",

"properties": {

"city": {

"type": "string",

"description": "Tên thành phố, ví dụ: 'Hanoi, VN'"

},

"unit": {

"type": "string",

"enum": ["celsius", "fahrenheit"],

"description": "Đơn vị nhiệt độ, mặc định là celsius."

}

},

"required": ["city"]

}

}Tương tự, chúng ta sẽ có các mô tả cho hàm gửi email (ví dụ: send_email(to, subject, body)) và tạo sự kiện lịch (ví dụ: create_calendar_event(summary, start_time, end_time, description)).

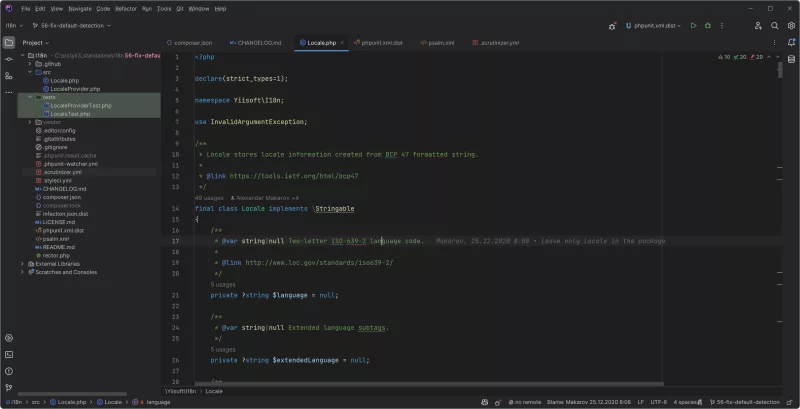

Bước 3: Code logic cho AI Agent

Chúng ta sẽ sử dụng một thư viện AI Agent framework (như LangChain, LlamaIndex, hay thậm chí là xây dựng thủ công với OpenAI API) để làm trung gian. Cốt lõi của AI Agent là khả năng gọi mô hình ngôn ngữ lớn (LLM) để quyết định hành động tiếp theo.

Đây là một đoạn mã Python minh họa cách một AI Agent có thể tương tác với các công cụ (API) bằng cách sử dụng một LLM:

import openai

import json

# Giả định các hàm thực thi API thực tế

def get_current_weather_api_call(city, unit="celsius"):

# Đây là nơi bạn gọi OpenWeatherMap API thực tế

print(f"Calling OpenWeatherMap for {city} in {unit}...")

# Giả lập kết quả

return {"city": city, "temperature": 28, "unit": unit, "description": "Nắng đẹp"}

def send_email_api_call(to, subject, body):

# Đây là nơi bạn gọi SendGrid API thực tế

print(f"Sending email to {to} with subject '{subject}' and body: {body}")

return {"status": "success", "message": "Email đã được gửi."}

def create_calendar_event_api_call(summary, start_time, end_time, description):

# Đây là nơi bạn gọi Google Calendar API thực tế

print(f"Creating calendar event: {summary} from {start_time} to {end_time}")

return {"status": "success", "event_id": "event123", "summary": summary}

# Định nghĩa các công cụ cho LLM

tools = [

{

"type": "function",

"function": {

"name": "get_current_weather",

"description": "Lấy thông tin thời tiết hiện tại cho một thành phố cụ thể.",

"parameters": {

"type": "object",

"properties": {

"city": {"type": "string", "description": "Tên thành phố, ví dụ: 'Hanoi, VN'"},

"unit": {"type": "string", "enum": ["celsius", "fahrenheit"], "description": "Đơn vị nhiệt độ, mặc định là celsius."}

},

"required": ["city"]

}

}

},

{

"type": "function",

"function": {

"name": "send_email",

"description": "Gửi một email đến người nhận được chỉ định.",

"parameters": {

"type": "object",

"properties": {

"to": {"type": "string", "description": "Địa chỉ email người nhận."},

"subject": {"type": "string", "description": "Chủ đề email."},

"body": {"type": "string", "description": "Nội dung email."}

},

"required": ["to", "subject", "body"]

}

}

},

{

"type": "function",

"function": {

"name": "create_calendar_event",

"description": "Tạo một sự kiện mới trong lịch.",

"parameters": {

"type": "object",

"properties": {

"summary": {"type": "string", "description": "Tiêu đề của sự kiện."},

"start_time": {"type": "string", "description": "Thời gian bắt đầu sự kiện (ISO 8601)."},

"end_time": {"type": "string", "description": "Thời gian kết thúc sự kiện (ISO 8601)."},

"description": {"type": "string", "description": "Mô tả chi tiết sự kiện."}

},

"required": ["summary", "start_time", "end_time"]

}

}

}

]

# Ánh xạ tên hàm sang hàm thực thi thực tế

available_functions = {

"get_current_weather": get_current_weather_api_call,

"send_email": send_email_api_call,

"create_calendar_event": create_calendar_event_api_call,

}

def run_conversation():

messages = [{"role": "user", "content": "Thời tiết ở Hà Nội hôm nay thế nào? Sau đó gửi email cho tôi ([email protected]) về nhiệt độ và tạo một sự kiện lịch 'Kiểm tra thời tiết' vào 10:00 - 11:00 sáng mai."}]

response = openai.chat.completions.create(

model="gpt-4-turbo-preview", # Hoặc gpt-3.5-turbo-0125

messages=messages,

tools=tools,

tool_choice="auto",

)

response_message = response.choices[0].message

tool_calls = response_message.tool_calls

if tool_calls:

messages.append(response_message) # Gửi phản hồi của trợ lý với các lệnh gọi công cụ

for tool_call in tool_calls:

function_name = tool_call.function.name

function_to_call = available_functions[function_name]

function_args = json.loads(tool_call.function.arguments)

function_response = function_to_call(**function_args)

messages.append(

{

"tool_call_id": tool_call.id,

"role": "tool",

"name": function_name,

"content": json.dumps(function_response),

}

) # Gửi kết quả của hàm trở lại mô hình

second_response = openai.chat.completions.create(

model="gpt-4-turbo-preview",

messages=messages,

)

return second_response.choices[0].message.content

else:

return response_message.content

print(run_conversation())Trong ví dụ trên, khi người dùng đưa ra yêu cầu, mô hình LLM sẽ phân tích và nhận diện các hành động cần thiết (lấy thời tiết, gửi email, tạo sự kiện). Nó sẽ tạo ra các lệnh gọi hàm (tool_calls) với các tham số phù hợp. Sau đó, code Python của chúng ta sẽ thực thi các hàm API thực tế và gửi kết quả trở lại cho LLM để nó tổng hợp và đưa ra phản hồi cuối cùng cho người dùng.

Đây là một ví dụ điển hình về cách một AI Agent tích hợp API hoạt động, biến một yêu cầu phức tạp thành một chuỗi các hành động tự động và hiệu quả. Khả năng này chính là chìa khóa để mở khóa tiềm năng vibe coding không giới hạn.

Tips và Best Practices Khi Phát Triển AI Agent Tích Hợp API

Để xây dựng AI Agent hiệu quả và đáng tin cậy, có một số kinh nghiệm và thực hành tốt bạn nên áp dụng:

- Mô tả API rõ ràng và chính xác: Đây là yếu tố quan trọng nhất. Mô tả hàm (

function description) phải đủ chi tiết để LLM hiểu được nó làm gì, mục đích và cách sử dụng các tham số. Sử dụng các tên hàm và tham số dễ hiểu, nhất quán. - Xử lý lỗi mạnh mẽ (Robust Error Handling): Các lệnh gọi API có thể thất bại. AI Agent của bạn cần có cơ chế để bắt lỗi, thông báo cho người dùng hoặc thử lại. LLM có thể được hướng dẫn để xử lý các phản hồi lỗi từ API và điều chỉnh kế hoạch.

- Quản lý trạng thái và bộ nhớ: Để AI Agent có thể thực hiện các tác vụ đa bước hoặc duy trì ngữ cảnh qua nhiều lần tương tác, nó cần một cơ chế bộ nhớ hiệu quả. Điều này có thể là lưu trữ lịch sử cuộc trò chuyện, các biến trạng thái, hoặc thậm chí là một cơ sở dữ liệu vector để truy xuất thông tin liên quan.

- Tối ưu hóa chi phí và hiệu suất: Mỗi lần gọi LLM và API đều tốn chi phí và thời gian. Thiết kế AI Agent để giảm thiểu các lệnh gọi không cần thiết, batch các yêu cầu API khi có thể và sử dụng các mô hình LLM phù hợp với từng tác vụ (mô hình nhỏ hơn cho các tác vụ đơn giản, mô hình lớn hơn cho suy luận phức tạp).

- Bảo mật và quyền riêng tư: Khi AI Agent tích hợp API với các dịch vụ khác, nó sẽ xử lý dữ liệu nhạy cảm. Đảm bảo rằng tất cả các API keys, thông tin xác thực được lưu trữ an toàn (ví dụ: biến môi trường, vault). Tuân thủ các quy định về bảo mật và quyền riêng tư dữ liệu.

- Thử nghiệm và lặp lại liên tục: AI Agent là một hệ thống phức tạp. Cần thử nghiệm kỹ lưỡng với nhiều kịch bản khác nhau, bao gồm cả các trường hợp biên và lỗi. Thu thập phản hồi và lặp lại thiết kế để cải thiện độ chính xác và độ tin cậy của Agent.

- Sử dụng các Tool/Agent Framework: Thay vì xây dựng mọi thứ từ đầu, hãy tận dụng các framework như LangChain, LlamaIndex, hay AutoGen. Chúng cung cấp các abstraction, module và công cụ cần thiết để phát triển AI Agent tích hợp API một cách nhanh chóng và hiệu quả.

So Sánh AI Agent Tích Hợp API Với Các Phương Pháp Tự Động Hóa Truyền Thống

Việc tự động hóa workflow không phải là khái niệm mới. Chúng ta đã có các công cụ như cron jobs, shell scripts, RPA (Robotic Process Automation), và các hệ thống tích hợp như Zapier hay IFTTT. Tuy nhiên, AI Agent tích hợp API mang đến một mức độ linh hoạt và thông minh hoàn toàn khác biệt.

So với Scripting truyền thống (shell scripts, Python scripts):

- Scripting: Yêu cầu lập trình viên phải định nghĩa rõ ràng từng bước thực hiện, xử lý các điều kiện rẽ nhánh và lỗi một cách thủ công. Mọi thứ đều mang tính mệnh lệnh (imperative).

- AI Agent: Hoạt động theo hướng khai báo (declarative). Người dùng chỉ cần nêu mục tiêu hoặc yêu cầu bằng ngôn ngữ tự nhiên. AI Agent sẽ tự động lập kế hoạch, chọn công cụ (API) phù hợp và thực thi các bước. Điều này giảm đáng kể công sức phát triển và bảo trì cho các workflow phức tạp, đặc biệt khi yêu cầu thay đổi.

So với RPA:

- RPA: Tập trung vào việc mô phỏng hành vi của con người trên giao diện người dùng (UI), thường là các tác vụ lặp đi lặp lại và có cấu trúc rõ ràng. RPA dễ vỡ khi giao diện người dùng thay đổi.

- AI Agent: Tương tác trực tiếp với các API, không phụ thuộc vào UI. Điều này giúp các giải pháp dựa trên AI Agent trở nên mạnh mẽ và ổn định hơn. Khả năng suy luận và thích ứng của AI Agent cũng vượt trội hơn RPA trong việc xử lý các tình huống bất định hoặc yêu cầu phức tạp.

So với các nền tảng tích hợp (Zapier, IFTTT):

- Các nền tảng tích hợp: Cung cấp giao diện đồ họa để người dùng kết nối các ứng dụng thông qua các "trigger" và "action" được định nghĩa trước. Chúng rất hữu ích cho các workflow đơn giản, tuyến tính.

- AI Agent: Có khả năng suy luận và lập kế hoạch động. Nó không chỉ thực hiện các "trigger-action" đã được cấu hình mà còn có thể tạo ra các chuỗi hành động mới dựa trên ngữ cảnh và mục tiêu. Khả năng này cho phép AI Agent xử lý các yêu cầu đa dạng, phi tuyến tính và yêu cầu nhiều bước suy luận hơn. Một AI Agent tích hợp API có thể tự mình tìm ra cách giải quyết vấn đề mà không cần được lập trình cụ thể cho từng kịch bản.

Nói tóm lại, AI Agent tích hợp API đại diện cho một bước tiến lớn trong tự động hóa. Nó kết hợp sức mạnh của các mô hình AI tiên tiến với khả năng kết nối không giới hạn của API, tạo ra một hệ thống tự động hóa thông minh, linh hoạt và có khả năng thích ứng cao, mở ra kỷ nguyên mới cho vibe coding.

Các Lưu Ý Quan Trọng

- Tính Deterministic (Xác định): Các mô hình LLM vốn dĩ không hoàn toàn deterministic. Điều này có nghĩa là cùng một yêu cầu có thể tạo ra các chuỗi hành động hơi khác nhau. Cần có cơ chế kiểm soát và xác nhận để đảm bảo tính nhất quán của các tác vụ quan trọng.

- Latency (Độ trễ): Mỗi lệnh gọi LLM và API đều có độ trễ. Đối với các workflow yêu cầu phản hồi nhanh, cần cân nhắc kỹ càng về kiến trúc và tối ưu hóa số lượng lệnh gọi.

- Context Window Management: LLM có giới hạn về lượng thông tin mà nó có thể xử lý trong một lần gọi (context window). Khi AI Agent thực hiện nhiều bước hoặc có lịch sử tương tác dài, việc quản lý context window (ví dụ: tóm tắt lịch sử, chỉ gửi thông tin liên quan) là cực kỳ quan trọng để duy trì hiệu suất và tránh vượt quá giới hạn.

- Tool Overload: Nếu AI Agent có quá nhiều công cụ (API) để lựa chọn, mô hình có thể gặp khó khăn trong việc chọn công cụ tối ưu hoặc bị nhầm lẫn. Cần cân nhắc việc tổ chức các công cụ thành các nhóm, hoặc chỉ cung cấp các công cụ cần thiết cho từng luồng công việc cụ thể.

- Human-in-the-Loop: Đối với các tác vụ quan trọng hoặc có rủi ro cao, việc có một "người giám sát" để phê duyệt hành động của AI Agent trước khi thực thi là một chiến lược an toàn. Điều này giúp ngăn chặn các sai sót không mong muốn.

- Cost Optimization: Chi phí cho các API của LLM và các dịch vụ khác có thể tăng lên nhanh chóng. Cần giám sát và tối ưu hóa việc sử dụng, ví dụ bằng cách sử dụng các mô hình nhỏ hơn cho các tác vụ đơn giản, caching kết quả API, hoặc batching các yêu cầu.

- Versioning và Compatibility: Các API và mô hình AI liên tục được cập nhật. Cần có chiến lược để quản lý phiên bản của các API mà AI Agent tích hợp, đảm bảo tính tương thích và dễ dàng nâng cấp.

Câu Hỏi Thường Gặp

AI Agent tích hợp API có thể thay thế hoàn toàn lập trình viên không?

Không, AI Agent tích hợp API không thể thay thế hoàn toàn lập trình viên. Thay vào đó, chúng là những công cụ mạnh mẽ giúp tự động hóa các tác vụ lặp đi lặp lại, tạo mã boilerplate, hoặc hỗ trợ trong việc tìm kiếm và kết nối các API. Chúng giải phóng lập trình viên khỏi công việc tẻ nhạt, cho phép họ tập trung vào tư duy kiến trúc, giải quyết vấn đề phức tạp và sự sáng tạo. AI Agent là cộng sự, không phải là đối thủ.

Làm thế nào để đảm bảo an toàn khi AI Agent gọi các API nhạy cảm?

Để đảm bảo an toàn, cần áp dụng các biện pháp như: sử dụng cơ chế xác thực mạnh mẽ (OAuth, API keys được quản lý chặt chẽ), cấp quyền truy cập tối thiểu (least privilege) cho AI Agent, mã hóa dữ liệu truyền tải, và thường xuyên kiểm tra lỗ hổng bảo mật. Việc triển khai một lớp proxy hoặc gateway để kiểm soát và giám sát các lệnh gọi API của AI Agent cũng là một phương pháp hiệu quả. Ngoài ra, việc có human-in-the-loop cho các hành động nhạy cảm là rất quan trọng.

AI Agent có thể tự động học cách sử dụng API mới mà không cần lập trình viên định nghĩa không?

Ở một mức độ nào đó, có. Các mô hình LLM tiên tiến có khả năng "zero-shot" hoặc "few-shot learning", tức là chúng có thể suy luận cách sử dụng một API mới dựa trên mô tả của nó (ví dụ: tài liệu OpenAPI) mà không cần ví dụ cụ thể. Tuy nhiên, để đạt được độ chính xác và độ tin cậy cao, việc cung cấp mô tả API rõ ràng và đôi khi là các ví dụ sử dụng (few-shot examples) vẫn là cần thiết. Việc tự động khám phá và thích nghi hoàn toàn với các API mới một cách độc lập vẫn là một lĩnh vực nghiên cứu đang phát triển.

Kết Luận

AI Agent tích hợp API đang mở ra một kỷ nguyên mới cho tự động hóa workflow phát triển phần mềm, biến những ý tưởng phức tạp thành hiện thực một cách nhanh chóng và hiệu quả. Khả năng kết nối và điều phối các dịch vụ đa dạng thông qua API cho phép chúng ta xây dựng các hệ thống thông minh, linh hoạt, giúp giảm tải công việc lặp lại và tăng cường sự sáng tạo.

Từ việc tự động hóa các tác vụ đơn giản đến việc quản lý toàn bộ chu trình phát triển, AI Agent không chỉ là một công cụ mà còn là một đối tác chiến lược, giúp các nhà phát triển đạt được một "vibe coding" không giới hạn. Bằng cách nắm vững các nguyên tắc và thực hành tốt nhất, chúng ta có thể khai thác tối đa tiềm năng của công nghệ này để tạo ra những giải pháp đột phá. Hãy cùng vibe coding và khám phá những khả năng vô tận mà AI Agent mang lại!