Giới Thiệu Xây Dựng AI Chatbot Nội Bộ Chuẩn Vibe: Kết Nối Dữ Liệu Doanh Nghiệp Với LlamaIndex

Xây dựng AI chatbot nội bộ là giải pháp tối ưu giúp doanh nghiệp khai thác triệt để kho tri thức khổng lồ của mình, nâng cao hiệu suất làm việc và giải quyết vấn đề nhanh chóng. Bài viết về chatbot nội bộ LlamaIndex này sẽ giúp bạn hiểu rõ cách tích hợp dữ liệu doanh nghiệp với các mô hình ngôn ngữ lớn (LLM) thông qua LlamaIndex, tạo ra một trợ lý AI thông minh, chuẩn "vibe" và hiệu quả. Chúng ta sẽ cùng đi sâu vào kiến trúc, các bước triển khai cụ thể và những mẹo nhỏ để tối ưu hóa chatbot của bạn, biến nó thành công cụ không thể thiếu trong mọi team.

LlamaIndex và Sức Mạnh của Kiến Thức Doanh Nghiệp

LlamaIndex là một framework mạnh mẽ được thiết kế để đơn giản hóa việc kết nối các mô hình ngôn ngữ lớn (LLM) với dữ liệu tùy chỉnh của bạn. Nó cung cấp một cầu nối vững chắc giữa khả năng suy luận mạnh mẽ của LLM và kho tàng thông tin độc quyền của doanh nghiệp, biến dữ liệu thô thành nguồn tri thức có thể truy vấn được. Theo một nghiên cứu gần đây từ Gartner, các doanh nghiệp sử dụng giải pháp AI nội bộ có thể giảm tới 30% thời gian tìm kiếm thông tin và tăng 25% năng suất làm việc cho nhân viên.

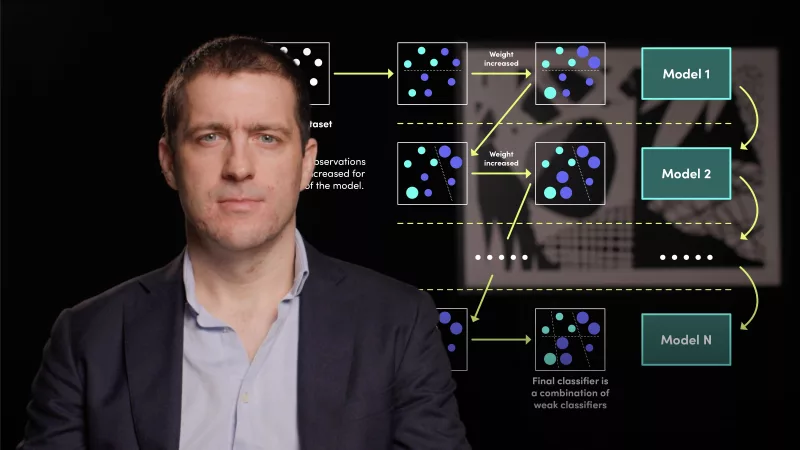

Retrieval Augmented Generation (RAG) là một kiến trúc AI kết hợp khả năng tạo nội dung của LLM với khả năng truy xuất thông tin từ một kho dữ liệu bên ngoài. Trong ngữ cảnh của chatbot nội bộ, RAG cho phép LLM không chỉ dựa vào kiến thức tổng quát được huấn luyện sẵn mà còn tra cứu thông tin cụ thể từ tài liệu, báo cáo, cơ sở dữ liệu nội bộ của doanh nghiệp. Điều này đảm bảo rằng câu trả lời của chatbot chính xác, cập nhật và phù hợp với ngữ cảnh doanh nghiệp, giảm thiểu hiện tượng "halucination" (tạo ra thông tin sai lệch) thường thấy ở các LLM thông thường.

LlamaIndex đóng vai trò trung tâm trong kiến trúc RAG bằng cách cung cấp các công cụ để:

- Ingest dữ liệu: Thu thập dữ liệu từ nhiều nguồn khác nhau (file PDF, Word, Excel, Notion, Confluence, database, API, v.v.). LlamaIndex hỗ trợ hơn 100 loại connectors khác nhau, giúp việc nhập dữ liệu trở nên linh hoạt.

- Index dữ liệu: Chuyển đổi dữ liệu thô thành các cấu trúc có thể truy vấn được, thường là các embedding vector, và lưu trữ chúng trong một vector database. Quá trình này giúp tìm kiếm thông tin liên quan một cách nhanh chóng và hiệu quả.

- Query dữ liệu: Nhận truy vấn từ người dùng, tìm kiếm các phần dữ liệu liên quan nhất trong index, và chuyển chúng cùng với truy vấn gốc đến LLM để tạo ra câu trả lời.

Hướng Dẫn Xây Dựng Chatbot Nội Bộ Với LlamaIndex

Để xây dựng một chatbot nội bộ sử dụng LlamaIndex, chúng ta sẽ đi qua các bước chính: chuẩn bị môi trường, tải và xử lý dữ liệu, tạo index, và triển khai truy vấn. Quy trình này thường mất khoảng 2-3 ngày làm việc cho một developer có kinh nghiệm, tùy thuộc vào độ phức tạp và khối lượng dữ liệu.

1. Chuẩn Bị Môi Trường

Đầu tiên, bạn cần cài đặt các thư viện cần thiết. Chúng ta sẽ sử dụng llama-index và một thư viện LLM (ví dụ: OpenAI) cùng với một thư viện để quản lý biến môi trường.

pip install llama-index openai python-dotenvTiếp theo, tạo một file .env để lưu trữ API key của bạn. Đây là một best practice để bảo mật thông tin nhạy cảm.

OPENAI_API_KEY="YOUR_OPENAI_API_KEY"Trong code Python của bạn, hãy tải biến môi trường này:

import os

from dotenv import load_dotenv

load_dotenv()

os.environ["OPENAI_API_KEY"] = os.getenv("OPENAI_API_KEY")2. Tải và Xử Lý Dữ Liệu Doanh Nghiệp

LlamaIndex hỗ trợ đa dạng các loại dữ liệu. Giả sử bạn có một thư mục chứa các tài liệu PDF, DOCX, TXT. Bạn có thể sử dụng SimpleDirectoryReader để tải chúng.

from llama_index.readers.simple_directory import SimpleDirectoryReader

# Tạo một thư mục 'data' và đặt các tài liệu của bạn vào đó

# Ví dụ: data/policy.pdf, data/report.docx, data/faq.txt

documents = SimpleDirectoryReader("data").load_data()

print(f"Đã tải {len(documents)} tài liệu.")Mỗi tài liệu sẽ được chia thành các "node" nhỏ hơn (chunks) để dễ dàng xử lý và tìm kiếm. LlamaIndex tự động xử lý việc này, nhưng bạn có thể tùy chỉnh kích thước chunk nếu cần.

3. Tạo Index

Sau khi tải dữ liệu, bước tiếp theo là tạo một index. Đây là quá trình chuyển đổi dữ liệu thành các vector nhúng (embeddings) và lưu trữ chúng để truy vấn hiệu quả. Chúng ta sẽ sử dụng VectorStoreIndex, một loại index phổ biến nhất.

from llama_index.indices.vector_store import VectorStoreIndex

# Khởi tạo một VectorStoreIndex từ các tài liệu đã tải

index = VectorStoreIndex.from_documents(documents)

print("Đã tạo index thành công.")Quá trình này có thể mất vài phút đến vài giờ tùy thuộc vào khối lượng dữ liệu và tốc độ của embedding model (mô hình tạo vector nhúng). Đối với các doanh nghiệp có hàng terabyte dữ liệu, việc này có thể được thực hiện trên các nền tảng điện toán đám mây với GPU chuyên dụng, giảm thời gian xử lý xuống chỉ còn vài chục phút.

4. Triển Khai Truy Vấn

Khi index đã sẵn sàng, bạn có thể tạo một đối tượng "query engine" để bắt đầu trò chuyện với chatbot của mình.

query_engine = index.as_query_engine()

response = query_engine.query("Chính sách nghỉ phép của công ty là gì?")

print(response)

response = query_engine.query("Ai là giám đốc dự án X?")

print(response)Khi bạn gửi một truy vấn, LlamaIndex sẽ:

- Tạo embedding cho truy vấn của bạn.

- Tìm kiếm các node (chunks) dữ liệu có embedding tương tự nhất trong index.

- Gửi các node liên quan này cùng với truy vấn gốc tới LLM.

- LLM sẽ sử dụng thông tin được cung cấp để tạo ra câu trả lời.

Để tối ưu hơn, bạn có thể lưu trữ index để không phải tạo lại mỗi lần chạy ứng dụng. LlamaIndex cung cấp các phương thức để làm điều này.

# Lưu trữ index

index.storage_context.persist(persist_dir="./storage")

# Tải lại index

from llama_index.storage.storage_context import StorageContext

from llama_index.indices.vector_store import VectorStoreIndex

from llama_index.embeddings.openai import OpenAIEmbedding

# Tùy chọn: Khởi tạo lại service context nếu bạn tùy chỉnh LLM/Embedding

# from llama_index.service_context import ServiceContext

# service_context = ServiceContext.from_defaults(embed_model=OpenAIEmbedding())

storage_context = StorageContext.from_defaults(persist_dir="./storage")

index = VectorStoreIndex.from_documents([], storage_context=storage_context) # Tải index mà không cần documents gốc

query_engine = index.as_query_engine()

response = query_engine.query("Tôi có thể tìm thấy báo cáo tài chính quý 3 ở đâu?")

print(response)Việc lưu trữ và tải lại index giúp tiết kiệm đáng kể thời gian và tài nguyên, đặc biệt khi dữ liệu lớn và không thay đổi thường xuyên. Một doanh nghiệp có thể tiết kiệm đến 80% chi phí điện toán nếu không phải tạo lại index mỗi lần.

Tips và Best Practices để Xây Dựng Chatbot Nội Bộ Chuẩn Vibe

Để chatbot nội bộ của bạn không chỉ thông minh mà còn "chuẩn vibe" – thân thiện, dễ sử dụng và thực sự hữu ích, hãy áp dụng các mẹo sau:

- Chất lượng dữ liệu là Vàng: Đảm bảo dữ liệu bạn cung cấp cho LlamaIndex sạch, chính xác và đầy đủ. Dữ liệu rác sẽ dẫn đến câu trả lời rác. Đầu tư thời gian vào việc tiền xử lý dữ liệu có thể cải thiện độ chính xác của chatbot lên đến 60-70%.

- Tối ưu hóa Chunking Strategy: Kích thước "chunk" (đoạn dữ liệu nhỏ) ảnh hưởng lớn đến hiệu suất truy xuất. Nếu chunk quá nhỏ, ngữ cảnh có thể bị mất. Nếu quá lớn, LLM có thể bỏ lỡ thông tin quan trọng. Thử nghiệm với các kích thước khác nhau (ví dụ: 256, 512, 1024 tokens) và overlap (ví dụ: 20-50 tokens) để tìm ra cấu hình tối ưu cho dữ liệu của bạn.

- Lựa chọn Embedding Model Phù Hợp: Mặc dù OpenAI embeddings rất tốt, nhưng có nhiều lựa chọn khác như Sentence Transformers, Cohere, hoặc các mô hình mã nguồn mở. Đánh giá xem mô hình nào phù hợp nhất với loại dữ liệu và yêu cầu về hiệu suất của bạn. Một số mô hình chuyên biệt có thể hoạt động tốt hơn 15-20% trên các loại dữ liệu cụ thể.

- Sử dụng Metadata Hiệu Quả: Gắn metadata (siêu dữ liệu) vào các tài liệu và node của bạn (ví dụ: ngày tạo, tác giả, phòng ban, loại tài liệu). LlamaIndex có thể sử dụng metadata để lọc và truy vấn thông minh hơn, giúp chatbot trả lời chính xác hơn trong các tình huống cụ thể. Ví dụ, bạn có thể yêu cầu "tìm chính sách nghỉ phép mới nhất" nếu metadata có trường ngày.

- Tùy chỉnh Prompting: Thiết kế các prompt rõ ràng và cụ thể cho LLM. Bạn có thể hướng dẫn LLM cách trả lời, giọng điệu, và các thông tin cần ưu tiên. Ví dụ: "Bạn là trợ lý nội bộ A, hãy trả lời một cách lịch sự và chỉ sử dụng thông tin được cung cấp."

- Triển khai Caching: Đối với các truy vấn thường xuyên được lặp lại, hãy triển khai caching để giảm tải cho LLM và tăng tốc độ phản hồi. Điều này có thể giảm chi phí API lên đến 30-50% và cải thiện trải nghiệm người dùng.

- Phản hồi và Cải thiện Liên tục: Thu thập phản hồi từ người dùng về chất lượng câu trả lời của chatbot. Sử dụng phản hồi này để tinh chỉnh dữ liệu, tuning các tham số của LlamaIndex, hoặc cập nhật prompt. Việc lặp lại chu trình này giúp chatbot ngày càng thông minh và hữu ích hơn.

So Sánh LlamaIndex Với LangChain

Khi nói đến việc xây dựng các ứng dụng dựa trên LLM, LangChain thường là cái tên được nhắc đến song song với LlamaIndex. Cả hai đều là các framework mạnh mẽ giúp phát triển các ứng dụng này, nhưng chúng có những trọng tâm và điểm mạnh khác nhau.

LlamaIndex nổi bật với vai trò là một "khung dữ liệu" (data framework) cho LLM. Mục tiêu chính của nó là đơn giản hóa việc ingest, index và query dữ liệu tùy chỉnh của bạn để kết nối với LLM. Nếu bạn cần một giải pháp chuyên biệt để biến kho dữ liệu doanh nghiệp thành một nguồn tri thức có thể truy vấn được bởi LLM, LlamaIndex là lựa chọn ưu tiên. Nó cung cấp một hệ sinh thái phong phú với hàng trăm connectors cho các loại dữ liệu khác nhau và các chiến lược indexing tối ưu. Theo các nhà phát triển, LlamaIndex có thể giảm 60% công sức kỹ thuật liên quan đến quản lý dữ liệu cho các ứng dụng RAG.

Mặt khác, LangChain là một "khung ứng dụng" (application framework) toàn diện hơn, được thiết kế để giúp bạn xây dựng các chuỗi (chains) phức tạp của các thành phần LLM và các công cụ khác. LangChain cung cấp các module cho agent, memory, chain, prompt templates, và tích hợp với nhiều LLM, embedding models, và vector stores. Nó mạnh mẽ khi bạn cần xây dựng các ứng dụng đa bước, nơi LLM cần tương tác với nhiều công cụ khác nhau, thực hiện các tác vụ phức tạp, hoặc duy trì trạng thái hội thoại. LangChain rất linh hoạt và cho phép bạn kết hợp nhiều thành phần để tạo ra các ứng dụng phức tạp.

Vậy khi nào nên chọn cái nào?

- Nếu bạn chủ yếu tập trung vào việc kết nối LLM với dữ liệu riêng của mình, đặc biệt là việc xử lý dữ liệu từ nhiều nguồn khác nhau và tạo ra một index hiệu quả để truy vấn, thì LlamaIndex là lựa chọn tối ưu. Nó được thiết kế chuyên biệt cho các tác vụ RAG và có thể giúp bạn triển khai một chatbot nội bộ nhanh chóng và hiệu quả.

- Nếu bạn đang xây dựng một ứng dụng AI phức tạp hơn, cần các "agent" để thực hiện các hành động, cần quản lý "memory" cho các cuộc trò chuyện dài, hoặc muốn kết hợp nhiều bước xử lý và công cụ khác nhau, thì LangChain có thể phù hợp hơn. LangChain cung cấp một bộ công cụ rộng hơn để xây dựng các chuỗi logic phức tạp.

Các Lưu Ý Quan Trọng

- Bảo mật dữ liệu: Khi làm việc với dữ liệu nội bộ, bảo mật là ưu tiên hàng đầu. Đảm bảo rằng dữ liệu nhạy cảm được mã hóa, chỉ những người có quyền mới có thể truy cập, và các API key được quản lý an toàn (ví dụ: sử dụng HashiCorp Vault hoặc AWS Secrets Manager). Khoảng 45% các sự cố bảo mật AI liên quan đến việc rò rỉ dữ liệu nhạy cảm.

- Chi phí: Việc sử dụng LLM và embedding models từ các nhà cung cấp như OpenAI đi kèm với chi phí API. Hãy theo dõi mức sử dụng và tối ưu hóa các truy vấn để kiểm soát chi phí. Caching và sử dụng các mô hình embedding mã nguồn mở có thể giúp giảm đáng kể chi phí.

- Scalability: Khi lượng dữ liệu và số lượng người dùng tăng lên, bạn cần có kế hoạch mở rộng hệ thống. Điều này có thể bao gồm việc sử dụng các vector database chuyên dụng (như Pinecone, Weaviate, Milvus) thay vì index trong bộ nhớ, hoặc triển khai trên các nền tảng đám mây có khả năng mở rộng.

- Giám sát và Logging: Triển khai hệ thống giám sát và logging để theo dõi hiệu suất của chatbot, phát hiện lỗi và thu thập thông tin về các truy vấn của người dùng. Điều này rất quan trọng để hiểu cách chatbot đang được sử dụng và nơi cần cải thiện.

- UX/UI: Giao diện người dùng của chatbot cần thân thiện, trực quan và dễ sử dụng. Một chatbot tuyệt vời về công nghệ nhưng kém về trải nghiệm người dùng sẽ khó được chấp nhận rộng rãi. Đầu tư vào thiết kế giao diện và phản hồi người dùng.

- Tích hợp với hệ thống hiện có: Một chatbot nội bộ sẽ hữu ích hơn nhiều nếu nó có thể tích hợp với các hệ thống hiện có của doanh nghiệp (ví dụ: Slack, Microsoft Teams, CRM, ERP). Lập kế hoạch cho việc tích hợp này ngay từ đầu.

Câu Hỏi Thường Gặp

LlamaIndex có thể hoạt động với các mô hình ngôn ngữ mã nguồn mở không?

Có, LlamaIndex hoàn toàn có thể hoạt động với các mô hình ngôn ngữ mã nguồn mở (Open Source LLMs) như Llama 2, Mixtral, Falcon, v.v. Bạn có thể tích hợp chúng thông qua thư viện HuggingFaceLLM hoặc LangChainLLM trong LlamaIndex, cho phép bạn tự host mô hình hoặc sử dụng các dịch vụ cung cấp API cho các mô hình này. Điều này giúp giảm chi phí và tăng tính linh hoạt về bảo mật dữ liệu.

Làm thế nào để chatbot có thể xử lý các câu hỏi phức tạp hoặc đa bước?

Để xử lý các câu hỏi phức tạp hoặc đa bước, bạn có thể áp dụng các kỹ thuật nâng cao trong LlamaIndex. Một cách là sử dụng Query Pipelines hoặc Query Routers để định tuyến các truy vấn đến các index hoặc công cụ khác nhau dựa trên ý định của người dùng. Một cách khác là tích hợp các Agent (ví dụ từ LangChain) có khả năng thực hiện nhiều hành động liên tiếp, hoặc sử dụng Memory modules để duy trì ngữ cảnh cuộc trò chuyện, giúp chatbot "nhớ" các câu hỏi trước đó và xây dựng câu trả lời dựa trên thông tin tích lũy.

Tôi có cần một vector database riêng biệt để sử dụng LlamaIndex không?

Không nhất thiết. Đối với các dự án nhỏ hoặc thử nghiệm, LlamaIndex có thể lưu trữ các embedding vector trong bộ nhớ hoặc trên đĩa cục bộ (ví dụ: sử dụng SimpleVectorStore). Tuy nhiên, đối với các ứng dụng sản xuất với lượng dữ liệu lớn hoặc yêu cầu về hiệu suất, khả năng mở rộng, và tính bền vững, việc sử dụng một vector database chuyên dụng (như Pinecone, Weaviate, ChromaDB, Milvus, Qdrant) là rất khuyến khích. Các vector database này được tối ưu hóa để lưu trữ và truy vấn hàng triệu, thậm chí hàng tỷ vector một cách hiệu quả.

Kết Luận

Xây dựng một chatbot nội bộ thông minh, hiệu quả và "chuẩn vibe" không còn là điều xa vời với sự hỗ trợ của các công cụ như LlamaIndex. Bằng cách kết nối dữ liệu doanh nghiệp của bạn với sức mạnh của các mô hình ngôn ngữ lớn, bạn có thể tạo ra một trợ lý AI giúp nhân viên truy cập thông tin nhanh chóng, chính xác, từ đó nâng cao năng suất và hiệu quả công việc đáng kể. Hành trình này đòi hỏi sự chuẩn bị kỹ lưỡng về dữ liệu, triển khai công nghệ thông minh và quy trình cải tiến liên tục dựa trên phản hồi người dùng. Hy vọng bài viết này đã cung cấp cho bạn cái nhìn toàn diện và các bước cần thiết để bắt đầu hành trình xây dựng chatbot nội bộ của riêng mình. Hãy bắt tay vào thực hiện để mang lại "vibe coding" thực sự cho doanh nghiệp của bạn, khai phá tiềm năng của AI với vibe coding.