Giới Thiệu: Phát Hiện Lỗi Logic AI Code – Kỹ Thuật Debug & Tối Ưu Hiệu Suất Với Vibe Coding

Chào mừng các bạn đến với vibecoding.vin! Trong thế giới phát triển AI đầy sôi động và phức tạp, việc tạo ra một mô hình hoạt động hoàn hảo ngay từ đầu gần như là điều không tưởng. Lỗi logic, hay những "bug" ẩn mình trong thuật toán, có thể khiến mô hình của chúng ta hoạt động không như mong đợi, thậm chí đưa ra kết quả sai lệch nghiêm trọng. Bài viết về debug AI code này sẽ giúp bạn đi sâu vào các kỹ thuật hiệu quả để phát hiện, phân tích và khắc phục những lỗi logic khó nhằn này, đồng thời tối ưu hóa hiệu suất của các hệ thống AI. Chúng ta sẽ cùng nhau khám phá những phương pháp thực tế, từ những công cụ cơ bản đến các chiến lược nâng cao, để đảm bảo code AI của bạn luôn chạy mượt mà và chính xác nhất.

Thế Giới Phức Tạp Của Lỗi Logic Trong AI Code

Lỗi logic trong code AI khác biệt đáng kể so với lỗi cú pháp hay lỗi runtime thông thường. Chúng không làm chương trình crash ngay lập tức, mà thay vào đó, dẫn đến hành vi không mong muốn hoặc kết quả sai lệch một cách tinh vi. Điều này đặc biệt nguy hiểm trong AI vì mô hình có thể vẫn chạy, vẫn đưa ra dự đoán, nhưng lại thiếu độ chính xác hoặc thiên vị (bias) mà không có cảnh báo rõ ràng. Ví dụ, một lỗi trong hàm tính toán loss có thể khiến mô hình không hội tụ, hoặc một lỗi trong tiền xử lý dữ liệu có thể làm sai lệch hoàn toàn quá trình huấn luyện.

Nguyên nhân của lỗi logic rất đa dạng: từ sai sót trong việc triển khai thuật toán, hiểu sai dữ liệu đầu vào, cho đến những tương tác phức tạp giữa các thành phần khác nhau của hệ thống AI. Khi làm việc với các mô hình học sâu, lỗi logic còn có thể xuất phát từ việc lựa chọn kiến trúc mạng không phù hợp, sai lầm trong việc khởi tạo trọng số, hoặc thậm chí là sự cố trong quá trình gradient descent. Việc debug AI code đòi hỏi một tư duy hệ thống và khả năng phân tích sâu sắc.

Một thách thức lớn khác là tính ngẫu nhiên và phi tuyến tính của nhiều mô hình AI. Cùng một lỗi logic có thể chỉ xuất hiện trong một số trường hợp dữ liệu nhất định, hoặc chỉ khi mô hình đạt đến một trạng thái cụ thể sau nhiều epoch huấn luyện. Điều này khiến việc tái hiện và gỡ lỗi trở nên vô cùng khó khăn. Do đó, việc áp dụng các kỹ thuật debug có hệ thống là chìa khóa để duy trì chất lượng và độ tin cậy của các giải pháp AI.

Hiểu rõ bản chất của các loại lỗi logic này là bước đầu tiên để phát triển một chiến lược debug AI code hiệu quả. Chúng ta không chỉ tìm kiếm "chỗ sai", mà còn phải hiểu "tại sao nó lại sai" và "làm thế nào để ngăn chặn nó tái diễn". Đây là một quá trình liên tục đòi hỏi sự kiên nhẫn và kinh nghiệm.

Kỹ Thuật Debug AI Code: Từ Cơ Bản Đến Nâng Cao

Để debug AI code hiệu quả, chúng ta cần trang bị một bộ công cụ và phương pháp đa dạng. Dưới đây là một số kỹ thuật chính:

1. In Log và Kiểm Tra Biến (Print Statements & Variable Inspection)

Đây là phương pháp debug cơ bản nhất nhưng lại vô cùng hiệu quả. Bằng cách in ra giá trị của các biến quan trọng, hình dạng (shape) của tensor, hoặc kết quả trung gian tại các bước khác nhau của thuật toán, chúng ta có thể theo dõi luồng dữ liệu và phát hiện điểm bất thường. Trong Python, các hàm như print() hoặc thư viện logging là công cụ đắc lực.

import torch

def simple_forward_pass(x, weights):

print(f"Input x shape: {x.shape}")

print(f"Weights shape: {weights.shape}")

# Giả sử có lỗi logic ở đây, ví dụ nhân sai chiều

# output = torch.matmul(x, weights.T) # Correct

output = torch.matmul(x, weights) # Incorrect, leads to shape mismatch or wrong result

print(f"Output shape after matmul: {output.shape}")

return output

# Ví dụ sử dụng

input_data = torch.randn(10, 5)

model_weights = torch.randn(5, 3)

try:

result = simple_forward_pass(input_data, model_weights)

print(f"Final result shape: {result.shape}")

except RuntimeError as e:

print(f"Runtime Error encountered: {e}")

Việc sử dụng print một cách có chiến lược, đặc biệt là trong các vòng lặp huấn luyện, có thể giúp bạn nhanh chóng khoanh vùng vấn đề khi các giá trị gradient trở nên NaN hoặc loss không giảm.

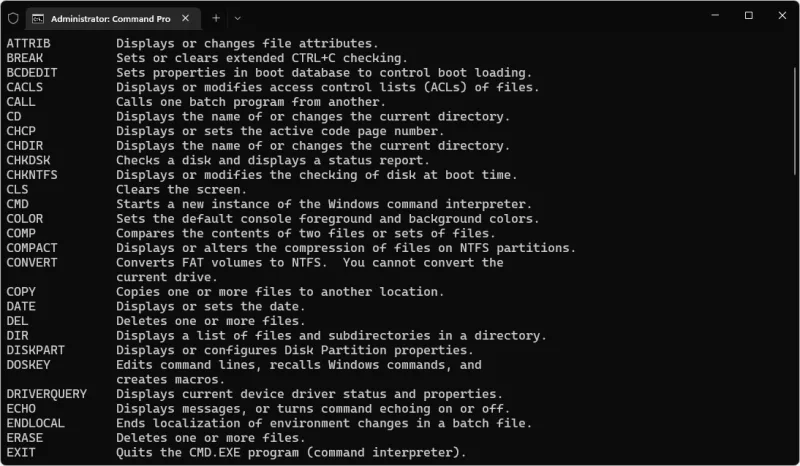

2. Sử Dụng Debugger (IDE Debuggers)

Các IDE hiện đại như VS Code, PyCharm cung cấp tích hợp debugger mạnh mẽ, cho phép bạn đặt breakpoint, chạy từng dòng code (step-by-step), kiểm tra giá trị biến tại bất kỳ thời điểm nào. Đây là một bước tiến lớn so với việc chỉ dùng print, giúp bạn có cái nhìn động về trạng thái chương trình.

- Breakpoints: Dừng chương trình tại một dòng code cụ thể.

- Step Over/Into/Out: Điều khiển luồng thực thi qua các hàm.

- Watch Variables: Theo dõi giá trị của các biến trong thời gian thực.

- Call Stack: Xem chuỗi các hàm đã được gọi để đến vị trí hiện tại.

Việc làm chủ debugger là kỹ năng cốt lõi cho mọi lập trình viên, và nó càng quan trọng khi bạn cần debug AI code phức tạp với nhiều lớp abstraction.

3. Kiểm Tra Dữ Liệu (Data Inspection)

Nhiều lỗi logic trong AI bắt nguồn từ dữ liệu đầu vào hoặc quá trình tiền xử lý dữ liệu.

- Kiểm tra phân phối: Đảm bảo dữ liệu có phân phối hợp lý, không có outliers quá lớn hoặc giá trị thiếu (missing values) không được xử lý. Sử dụng các thư viện như

pandasvàmatplotlibđể visualize dữ liệu. - Kiểm tra định dạng và kích thước: Đảm bảo các tensor có kích thước (shape) phù hợp với yêu cầu của mô hình ở mọi bước. Lỗi về shape là rất phổ biến trong deep learning.

- Kiểm tra giá trị biên: Test mô hình với các trường hợp dữ liệu đặc biệt (ví dụ: tất cả số 0, tất cả số lớn, dữ liệu hoàn toàn nhiễu) để xem phản ứng của nó.

import pandas as pd

import numpy as np

# Giả sử có một DataFrame dữ liệu

data = {

'feature1': np.random.rand(100),

'feature2': np.random.randint(0, 10, 100),

'target': np.random.choice([0, 1], 100)

}

df = pd.DataFrame(data)

# Kiểm tra thông tin cơ bản

print("DataFrame Info:")

df.info()

# Kiểm tra giá trị null

print("\nMissing values:")

print(df.isnull().sum())

# Kiểm tra thống kê mô tả

print("\nDescriptive Statistics:")

print(df.describe())

# Kiểm tra phân phối của một feature

# import matplotlib.pyplot as plt

# plt.hist(df['feature1'], bins=20)

# plt.title('Distribution of Feature 1')

# plt.show()

4. Phân Tích Loss Function và Gradient

Trong huấn luyện mô hình học sâu, loss function và gradient là hai chỉ số quan trọng nhất.

- Loss không giảm: Có thể do learning rate quá thấp, lỗi trong tính toán gradient, hoặc mô hình không đủ khả năng học.

- Loss tăng vọt hoặc trở thành

NaN: Thường là dấu hiệu của exploding gradients, learning rate quá cao, hoặc lỗi trong loss function. Kiểm tra gradient norm có thể giúp xác định vấn đề này. - Gradient trở thành

NaNhoặcinf: Thường xảy ra khi có phép chia cho 0, log của số âm, hoặc giá trị quá lớn trong quá trình lan truyền ngược.

Sử dụng các công cụ như TensorBoard hoặc Weights & Biases để theo dõi loss, accuracy, và gradient histogram theo thời gian là cực kỳ hữu ích để phát hiện các bất thường.

5. Kiểm Tra Từng Thành Phần (Unit Testing)

Thay vì debug AI code toàn bộ hệ thống, hãy tách nhỏ mô hình thành các thành phần độc lập (ví dụ: lớp tiền xử lý dữ liệu, lớp kiến trúc mạng, hàm tính toán loss) và kiểm tra từng thành phần riêng biệt. Điều này giúp cô lập lỗi và xác định chính xác phần nào gây ra vấn đề. Viết các unit test cho các hàm quan trọng là một best practice.

6. So Sánh Với Triển Khai Tham Chiếu (Reference Implementation)

Nếu bạn đang triển khai một thuật toán đã biết, hãy tìm một triển khai tham chiếu (ví dụ: trên GitHub, paper với code đi kèm) và so sánh từng bước output của bạn với output của triển khai tham chiếu. Điều này giúp bạn xác định chính xác bước nào trong thuật toán của bạn đang cho ra kết quả khác biệt.

Tips & Best Practices để Debug AI Code Hiệu Quả

1. Bắt Đầu Với Một Mô Hình Đơn Giản

Khi gặp lỗi, hãy thử làm đơn giản hóa vấn đề. Giảm kích thước mô hình, sử dụng tập dữ liệu nhỏ hơn (hoặc thậm chí là dữ liệu tổng hợp), hoặc chỉ huấn luyện trên một batch duy nhất. Nếu mô hình đơn giản vẫn gặp lỗi, bạn có thể dễ dàng khoanh vùng hơn. Nếu mô hình đơn giản hoạt động, dần dần tăng độ phức tạp để tìm ra điểm gây lỗi.

2. Sử Dụng Kiểm Tra Hình Dạng (Shape Checking)

Trong Deep Learning, lỗi về hình dạng (shape) của tensor là một trong những loại lỗi phổ biến nhất. Luôn luôn kiểm tra .shape của các tensor sau mỗi phép toán quan trọng. Nhiều framework như PyTorch hay TensorFlow sẽ báo lỗi nếu shape không tương thích, nhưng đôi khi chúng vẫn chạy và cho ra kết quả sai lệch mà không báo lỗi rõ ràng.

import torch

def check_shapes(input_tensor, layer_weights):

print(f"Input tensor shape: {input_tensor.shape}")

print(f"Layer weights shape: {layer_weights.shape}")

# Ví dụ một phép nhân ma trận

if input_tensor.shape[1] != layer_weights.shape[0]:

raise ValueError("Mismatch in dimensions for matrix multiplication!")

output_tensor = torch.matmul(input_tensor, layer_weights)

print(f"Output tensor shape: {output_tensor.shape}")

return output_tensor

# Sử dụng

x = torch.randn(4, 5)

w = torch.randn(5, 10)

try:

y = check_shapes(x, w)

except ValueError as e:

print(f"Error: {e}")

3. Visualize Mọi Thứ Có Thể

Con người là sinh vật trực quan. Visualize dữ liệu đầu vào, đầu ra của từng lớp trong mạng, các trọng số (weights), gradient, và thậm chí cả các biểu đồ loss, accuracy theo thời gian. Các thư viện như Matplotlib, Seaborn, và các công cụ như TensorBoard, Weights & Biases là những người bạn tốt nhất của bạn trong quá trình debug AI code.

4. Kiểm Soát Tính Ngẫu Nhiên (Seed Randomness)

Để đảm bảo khả năng tái hiện lỗi, luôn thiết lập seed cho tất cả các thư viện liên quan đến tính ngẫu nhiên (NumPy, PyTorch, TensorFlow, Python's random module). Điều này giúp bạn có thể chạy lại code nhiều lần và gặp phải lỗi tương tự, thay vì một lỗi xuất hiện ngẫu nhiên và khó bắt.

import torch

import numpy as np

import random

def set_seed(seed_value):

random.seed(seed_value)

np.random.seed(seed_value)

torch.manual_seed(seed_value)

if torch.cuda.is_available():

torch.cuda.manual_seed(seed_value)

torch.cuda.manual_seed_all(seed_value)

torch.backends.cudnn.deterministic = True

torch.backends.cudnn.benchmark = False

set_seed(42)

# Bây giờ bạn có thể chạy code và mong đợi kết quả có thể tái hiện được

5. Học Cách Đọc Traceback và Error Messages

Khi một lỗi xảy ra, traceback (dấu vết lỗi) cung cấp thông tin quý giá về nơi lỗi xảy ra và nguyên nhân ban đầu. Đừng bỏ qua chúng. Hãy đọc kỹ từng dòng, đặc biệt là các dòng cuối cùng, để xác định file, dòng code và loại lỗi. Các thông báo lỗi từ các framework AI thường rất chi tiết và hữu ích.

6. Sử Dụng Gradient Checking (Đối với Mô Hình Cổ Điển Hơn)

Đối với các mô hình với kiến trúc đơn giản hơn hoặc các phần mới được phát triển, gradient checking (kiểm tra gradient bằng phương pháp xấp xỉ số) có thể giúp xác nhận rằng đạo hàm được tính toán chính xác. Các framework học sâu hiện đại thường tự động tính gradient chính xác, nhưng kỹ thuật này vẫn hữu ích khi bạn xây dựng một lớp tùy chỉnh (custom layer) hoặc một loss function mới.

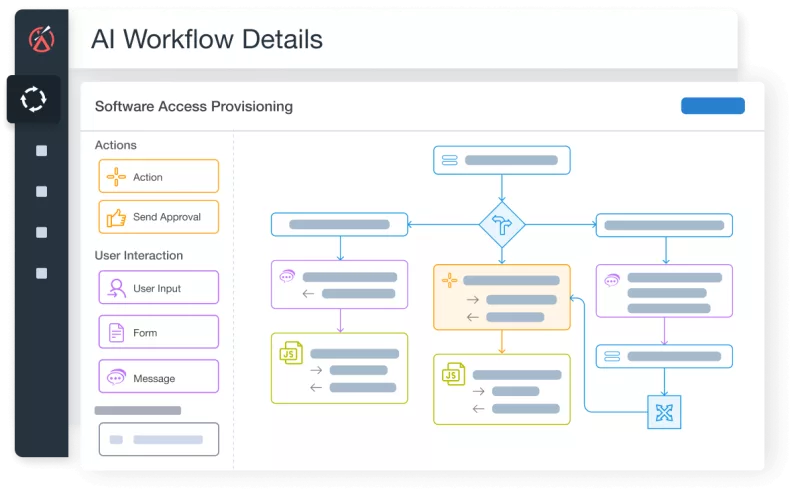

So Sánh Các Phương Pháp Debug AI Code

Mỗi phương pháp debug AI code đều có ưu và nhược điểm riêng, và việc lựa chọn phương pháp phù hợp phụ thuộc vào loại lỗi, độ phức tạp của hệ thống và giai đoạn phát triển.

- Print statements: Nhanh chóng, dễ triển khai, hữu ích cho việc kiểm tra luồng dữ liệu và giá trị biến. Nhược điểm là có thể làm bùng nổ console và khó quản lý trong code phức tạp.

- IDE Debuggers: Mạnh mẽ, cung cấp kiểm soát chi tiết, cho phép xem trạng thái chương trình động. Tuy nhiên, có thể chậm hơn khi xử lý dữ liệu lớn hoặc trong các môi trường phân tán.

- Data Inspection & Visualization: Cực kỳ quan trọng để hiểu dữ liệu và phát hiện lỗi do dữ liệu. Đòi hỏi thời gian và công cụ phụ trợ.

- Unit Testing: Giúp ngăn chặn lỗi tái diễn, xác minh tính đúng đắn của từng thành phần. Tuy nhiên, việc viết unit test có thể tốn thời gian ban đầu.

- TensorBoard/Weights & Biases: Tuyệt vời cho việc theo dõi quá trình huấn luyện và phân tích hiệu suất tổng thể. Không trực tiếp chỉ ra lỗi logic cụ thể trong code mà là biểu hiện của chúng.

Trong thực tế, một chiến lược debug AI code hiệu quả thường kết hợp nhiều phương pháp. Bắt đầu với việc kiểm tra dữ liệu và theo dõi logs/metrics. Nếu có vấn đề, sử dụng print hoặc debugger để đi sâu vào code. Cuối cùng, viết unit test để đảm bảo lỗi không tái diễn. Việc hiểu rõ khi nào nên dùng công cụ nào sẽ giúp bạn tiết kiệm rất nhiều thời gian và công sức.

Các Lưu Ý Quan Trọng Khi Debug AI Code

- Đừng thay đổi quá nhiều thứ cùng lúc: Khi bạn cố gắng khắc phục một lỗi, hãy thay đổi một thứ duy nhất và kiểm tra lại. Nếu bạn thay đổi nhiều thứ, bạn sẽ không biết thay đổi nào đã khắc phục lỗi (hoặc tạo ra lỗi mới).

- Sử dụng Git (hoặc hệ thống quản lý phiên bản khác): Luôn commit code của bạn trước khi bắt đầu một phiên debug lớn. Điều này cho phép bạn dễ dàng quay lại các phiên bản trước nếu mọi thứ trở nên tồi tệ hơn.

- Nghỉ ngơi: Khi bạn đã dành hàng giờ để tìm kiếm một lỗi mà không thành công, hãy đứng dậy, đi dạo hoặc làm việc khác. Một cái nhìn mới thường có thể giúp bạn phát hiện ra điều bạn đã bỏ lỡ.

- Hỏi đồng nghiệp: Đôi khi, một cặp mắt khác có thể phát hiện ra lỗi mà bạn đã nhìn qua hàng trăm lần. Việc giải thích vấn đề cho người khác cũng có thể giúp bạn tự mình tìm ra giải pháp.

- Kiểm tra lại giả định của bạn: Rất nhiều lỗi logic đến từ việc có những giả định sai lầm về cách dữ liệu hoạt động, cách một hàm hoạt động, hoặc cách mô hình học.

- Sử dụng môi trường ảo: Đảm bảo bạn đang làm việc trong một môi trường ảo (ví dụ:

condahoặcvenv) để tránh xung đột phiên bản thư viện, một nguyên nhân phổ biến của các lỗi khó hiểu. - Đọc tài liệu: Nếu bạn đang sử dụng một thư viện hoặc framework mới, hãy dành thời gian đọc tài liệu API của nó. Nhiều lỗi xảy ra do hiểu sai cách sử dụng một hàm hoặc một lớp.

Câu Hỏi Thường Gặp

Làm thế nào để phân biệt lỗi logic và lỗi cú pháp/runtime trong AI code?

Lỗi cú pháp (syntax errors) sẽ ngăn chương trình biên dịch hoặc chạy ngay từ đầu (ví dụ: thiếu dấu hai chấm, sai tên biến). Lỗi runtime (runtime errors) sẽ làm chương trình crash trong quá trình thực thi (ví dụ: chia cho 0, truy cập index ngoài giới hạn). Lỗi logic (logic errors) thì khác, chương trình vẫn chạy mà không báo lỗi, nhưng kết quả đầu ra lại không chính xác hoặc không mong muốn, thường đòi hỏi phân tích sâu hơn để phát hiện.

Khi nào nên sử dụng TensorBoard thay vì debugger truyền thống?

TensorBoard (hoặc các công cụ tương tự như Weights & Biases) là lý tưởng để theo dõi quá trình huấn luyện của mô hình học sâu, visualize các metric (loss, accuracy, F1-score), phân phối trọng số và gradient theo thời gian. Nó giúp bạn hiểu hành vi tổng thể của mô hình và phát hiện các vấn đề như overfitting, underfitting, hoặc gradient vanishing/exploding. Debugger truyền thống thì tập trung vào việc đi sâu vào từng dòng code, kiểm tra giá trị biến tức thời để tìm ra nguyên nhân gốc rễ của một lỗi logic cụ thể.

Làm thế nào để debug các mô hình AI phi tuyến tính và "hộp đen"?

Với các mô hình phức tạp như mạng nơ-ron sâu, việc debug trở nên khó khăn hơn. Các kỹ thuật như SHAP (SHapley Additive exPlanations) hay LIME (Local Interpretable Model-agnostic Explanations) giúp giải thích dự đoán của mô hình bằng cách xác định tầm quan trọng của từng feature. Ngoài ra, việc kiểm tra các kích hoạt (activations) của từng lớp, sử dụng Grad-CAM để visualize các vùng ảnh hưởng trong ảnh, hoặc thực hiện các thử nghiệm đối kháng (adversarial examples) cũng có thể cung cấp cái nhìn sâu sắc về cách mô hình hoạt động và nơi nó có thể mắc lỗi logic.

Kết Luận

Debug AI code là một kỹ năng không thể thiếu đối với mọi nhà phát triển AI. Nó không chỉ là việc tìm và sửa lỗi, mà còn là quá trình hiểu sâu hơn về cách mô hình của bạn hoạt động, dữ liệu của bạn được xử lý như thế nào, và làm thế nào để tối ưu hóa hiệu suất. Bằng cách áp dụng một cách có hệ thống các kỹ thuật từ cơ bản đến nâng cao, kết hợp với tư duy phân tích và sự kiên nhẫn, bạn có thể giải quyết những thách thức debug phức tạp nhất.

Hy vọng rằng bài viết này đã cung cấp cho bạn những kiến thức và công cụ cần thiết để tự tin hơn trong hành trình phát triển AI của mình. Hãy luôn nhớ rằng, mỗi lỗi được khắc phục là một bài học quý giá, giúp bạn xây dựng những hệ thống AI mạnh mẽ và đáng tin cậy hơn. Đừng ngần ngại khám phá thêm nhiều bài viết hữu ích khác tại vibe coding để nâng cao kỹ năng lập trình và phát triển AI của bạn!