Giới Thiệu Tối Ưu Chi Phí AI API

Trong kỷ nguyên số hóa, các API AI đang trở thành xương sống của nhiều ứng dụng hiện đại, từ chatbot thông minh, phân tích dữ liệu đến tự động hóa quy trình. Tuy nhiên, việc sử dụng các dịch vụ AI này đi kèm với một thách thức không nhỏ: chi phí. Đặc biệt đối với các startup, dự án cá nhân, hoặc doanh nghiệp nhỏ, việc quản lý hiệu quả chi phí AI API là yếu tố then chốt để đảm bảo tính bền vững và khả năng mở rộng. Bài viết này sẽ đi sâu vào chiến lược tối ưu chi phí AI API, cung cấp cái nhìn toàn diện từ việc lựa chọn nhà cung cấp đến các kỹ thuật quản lý cụ thể. Chúng ta sẽ cùng khám phá cách tận dụng sức mạnh của AI mà vẫn giữ được ngân sách trong tầm kiểm soát.

Hiểu Rõ Chi Phí AI API và Các Yếu Tố Ảnh Hưởng

Trước khi đi sâu vào các chiến lược tối ưu, điều quan trọng là phải hiểu rõ cách thức các nhà cung cấp AI tính phí cho dịch vụ của họ. Hầu hết các API AI đều áp dụng mô hình thanh toán dựa trên mức sử dụng (pay-as-you-go), nhưng chi tiết về "mức sử dụng" có thể rất đa dạng. Ví dụ, các API xử lý ngôn ngữ tự nhiên (NLP) như OpenAI GPT-3/4 thường tính phí dựa trên số lượng token (từ, ký tự) được xử lý, cả input và output. API nhận dạng hình ảnh có thể tính phí theo số lượng hình ảnh hoặc số lượng feature được phát hiện. Các dịch vụ chuyển đổi giọng nói thành văn bản (Speech-to-Text) sẽ tính phí theo số giây hoặc phút âm thanh được xử lý.

Các yếu tố khác ảnh hưởng đến chi phí bao gồm: mô hình cụ thể được sử dụng (ví dụ: GPT-3.5 rẻ hơn GPT-4), dung lượng dữ liệu truyền tải, tốc độ truy cập (thường có các gói cao cấp cho độ trễ thấp hơn), và các tính năng bổ sung như fine-tuning mô hình tùy chỉnh hoặc hỗ trợ kỹ thuật ưu tiên. Ngoài ra, một số nhà cung cấp có thể có các cấp độ miễn phí (free tier) giới hạn, rất hữu ích cho việc thử nghiệm và phát triển ban đầu, nhưng cần được giám sát chặt chẽ khi ứng dụng đi vào sản phẩm thực tế.

Việc hiểu rõ từng thành phần chi phí giúp chúng ta có cái nhìn tổng quan về "điểm nóng" (hot spots) chi tiêu và từ đó đưa ra các quyết định tối ưu hơn. Một lỗi phổ biến là chỉ nhìn vào giá trên mỗi đơn vị mà quên đi tổng khối lượng sử dụng dự kiến, hoặc không tính toán đến các chi phí ẩn như dữ liệu lưu trữ tạm thời hay băng thông mạng.

Chiến Lược Lựa Chọn Nhà Cung Cấp AI API Thông Minh

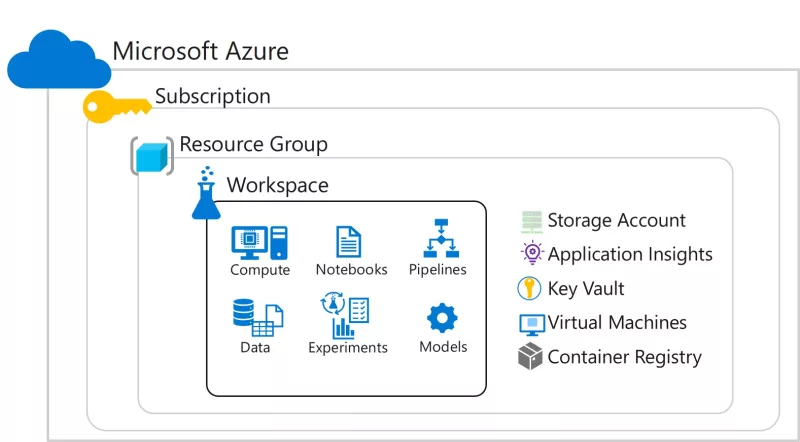

Lựa chọn nhà cung cấp AI API phù hợp là bước đầu tiên và quan trọng nhất trong việc tối ưu chi phí. Thị trường hiện nay có rất nhiều lựa chọn, từ các ông lớn như Google Cloud AI, AWS AI/ML, Microsoft Azure AI đến các nhà cung cấp chuyên biệt như OpenAI, Anthropic, Hugging Face. Mỗi nhà cung cấp có những ưu và nhược điểm riêng về giá cả, hiệu suất, tính năng và độ dễ sử dụng.

- Đánh giá nhu cầu thực tế: Không phải lúc nào mô hình AI mạnh nhất cũng là lựa chọn tốt nhất. Đối với nhiều tác vụ, một mô hình nhỏ hơn, chuyên biệt hơn có thể mang lại hiệu suất đủ tốt với chi phí thấp hơn đáng kể. Ví dụ, nếu bạn chỉ cần trích xuất thực thể đơn giản, một mô hình NLP cơ bản có thể hiệu quả hơn GPT-4.

- So sánh bảng giá chi tiết: Đừng chỉ nhìn vào giá "mặt tiền". Hãy đào sâu vào các cấp độ giá, các gói chiết khấu cho khối lượng lớn, và các chính sách về token/kí tự/hình ảnh/giây. Một số nhà cung cấp có thể có giá cao hơn trên mỗi đơn vị nhưng lại cung cấp các tính năng giúp giảm tổng số lượng đơn vị cần xử lý (ví dụ: khả năng xử lý batch hiệu quả).

- Xem xét khả năng tích hợp và hệ sinh thái: Một nhà cung cấp có hệ sinh thái mạnh mẽ (SDK, tài liệu, cộng đồng, tích hợp với các dịch vụ khác) có thể giảm chi phí phát triển và bảo trì. Mặc dù không trực tiếp là chi phí API, chi phí phát triển cũng là một phần tổng chi phí dự án.

- Kiểm tra chính sách miễn phí và dùng thử: Tận dụng tối đa các cấp độ miễn phí hoặc thời gian dùng thử để kiểm tra hiệu suất và ước tính chi phí trước khi cam kết. Điều này giúp bạn hiểu rõ hơn về mức độ phù hợp của API với use case của mình mà không tốn kém.

Ví dụ, khi cần một API tạo văn bản, bạn có thể bắt đầu với API GPT-3.5 Turbo của OpenAI hoặc các mô hình mã nguồn mở được host trên Hugging Face Inference API. Chỉ khi nhu cầu của bạn thực sự đòi hỏi khả năng phức tạp hơn, bạn mới nên cân nhắc GPT-4.

Quản Lý Sử Dụng API Hiệu Quả và Tối Ưu Hóa Kỹ Thuật

Sau khi đã chọn được nhà cung cấp, việc quản lý và tối ưu hóa cách ứng dụng tương tác với API là cực kỳ quan trọng để kiểm soát chi phí. Đây là nơi các kỹ năng lập trình và kiến trúc hệ thống phát huy tác dụng.

1. Caching và Tái Sử Dụng Kết Quả

Một trong những kỹ thuật hiệu quả nhất để giảm chi phí API là caching. Nếu ứng dụng của bạn thường xuyên yêu cầu cùng một dữ liệu hoặc thực hiện cùng một tác vụ AI với cùng một đầu vào, việc lưu trữ kết quả đầu ra sẽ giúp bạn tránh phải gọi lại API và tốn phí. Điều này đặc biệt hữu ích cho các tác vụ như dịch thuật, tóm tắt nội dung tĩnh, hoặc phân loại dữ liệu ít thay đổi.

import hashlib

import json

import os

# Giả định một hàm gọi API

def call_ai_api(input_text):

# Đây sẽ là nơi bạn thực sự gọi API AI

# Ví dụ: response = openai.Completion.create(...)

print(f"Calling AI API for: {input_text[:50]}...")

return {"generated_text": f"Processed: {input_text}"}

def get_cached_or_call_api(input_text, cache_dir="ai_cache"):

os.makedirs(cache_dir, exist_ok=True)

input_hash = hashlib.md5(input_text.encode('utf-8')).hexdigest()

cache_file = os.path.join(cache_dir, f"{input_hash}.json")

if os.path.exists(cache_file):

print(f"Loading from cache: {cache_file}")

with open(cache_file, 'r', encoding='utf-8') as f:

return json.load(f)

else:

result = call_ai_api(input_text)

with open(cache_file, 'w', encoding='utf-8') as f:

json.dump(result, f, ensure_ascii=False, indent=2)

return result

# Sử dụng

print(get_cached_or_call_api("What is the capital of France?"))

# Lần gọi thứ hai với cùng đầu vào sẽ dùng cache

print(get_cached_or_call_api("What is the capital of France?"))

Đoạn code trên minh họa một cách đơn giản để implement caching bằng cách tạo một hash từ input và lưu trữ kết quả vào một file JSON cục bộ. Trong môi trường production, bạn có thể cân nhắc sử dụng các giải pháp cache mạnh mẽ hơn như Redis hoặc Memcached.

2. Batch Processing

Nhiều API AI cung cấp khả năng xử lý theo lô (batch processing), cho phép bạn gửi nhiều yêu cầu cùng lúc trong một lần gọi API duy nhất. Điều này thường hiệu quả hơn về chi phí và thời gian so với việc gửi từng yêu cầu riêng lẻ, do giảm overhead mạng và xử lý.

Ví dụ, nếu bạn cần phân tích cảm xúc của hàng trăm bình luận, thay vì gọi API cho từng bình luận, hãy gom chúng lại thành một gói và gửi đi. Hãy kiểm tra tài liệu của nhà cung cấp API để xem họ có hỗ trợ batch processing hay không và cách triển khai.

3. Giảm Kích Thước Đầu Vào

Đối với các API tính phí theo token/kí tự, việc giảm kích thước đầu vào (input payload) có thể mang lại lợi ích đáng kể. Hãy đảm bảo rằng bạn chỉ gửi những thông tin thực sự cần thiết cho API. Điều này có thể bao gồm:

- Tiền xử lý (pre-processing): Loại bỏ các phần không liên quan, nhiễu, hoặc thông tin trùng lặp khỏi văn bản trước khi gửi.

- Tóm tắt (summarization): Nếu chỉ cần ý chính, hãy tóm tắt văn bản dài trước khi gửi cho các tác vụ như phân loại hoặc trích xuất thực thể.

- Nén dữ liệu: Đối với dữ liệu hình ảnh hoặc âm thanh, hãy đảm bảo rằng chúng được nén ở mức độ hợp lý mà vẫn giữ được chất lượng cần thiết.

def preprocess_text_for_ai(long_text):

# Ví dụ đơn giản: loại bỏ các dòng trống và khoảng trắng thừa

# Trong thực tế có thể phức tạp hơn: loại bỏ HTML tags, stopwords, v.v.

cleaned_lines = [line.strip() for line in long_text.splitlines() if line.strip()]

return " ".join(cleaned_lines)

# Giả sử một văn bản dài từ một bài báo

article_text = """

This is a very long article about AI.

It discusses various aspects of artificial intelligence,

including machine learning, deep learning, and natural language processing.

The article also touches upon the future of AI and its potential impact.

"""

processed_text = preprocess_text_for_ai(article_text)

print(f"Original length: {len(article_text)} characters")

print(f"Processed length: {len(processed_text)} characters")

# Sau đó gửi processed_text này đến API thay vì article_text

4. Giám Sát và Thiết Lập Ngưỡng (Monitoring & Throttling)

Không thể tối ưu chi phí nếu bạn không biết mình đang chi tiêu bao nhiêu. Thiết lập hệ thống giám sát chi phí API là cực kỳ quan trọng. Hầu hết các nhà cung cấp lớn đều có dashboard quản lý chi phí. Ngoài ra, bạn có thể tích hợp các công cụ giám sát của bên thứ ba hoặc tự xây dựng hệ thống theo dõi.

Khi đã có dữ liệu, hãy thiết lập các ngưỡng cảnh báo (alerts) để được thông báo khi chi phí hoặc mức sử dụng vượt quá một giới hạn nhất định. Trong một số trường hợp, bạn có thể cần triển khai cơ chế điều tiết (throttling) hoặc ngắt mạch (circuit breaker) trong ứng dụng của mình để tạm dừng hoặc giảm thiểu các lệnh gọi API khi ngân sách sắp cạn hoặc có dấu hiệu sử dụng bất thường.

Tips và Best Practices để Tối Ưu Chi Phí AI API

Để thực sự tối ưu chi phí AI API, chúng ta cần áp dụng một cách tiếp cận đa chiều, kết hợp cả chiến lược kinh doanh và kỹ thuật.

1. Sử Dụng Mô Hình AI Mã Nguồn Mở Khi Có Thể

Đối với nhiều tác vụ AI phổ biến, có rất nhiều mô hình mã nguồn mở chất lượng cao có sẵn (ví dụ: trên Hugging Face Model Hub). Bằng cách tự host các mô hình này trên cơ sở hạ tầng của riêng bạn (ví dụ: máy chủ GPU trên AWS, Google Cloud, Azure hoặc thậm chí là một máy chủ cục bộ), bạn có thể loại bỏ hoàn toàn chi phí API trên mỗi lần gọi. Tuy nhiên, điều này đi kèm với chi phí quản lý cơ sở hạ tầng, duy trì mô hình, và chi phí GPU. Cần có sự cân nhắc kỹ lưỡng giữa chi phí API và chi phí vận hành.

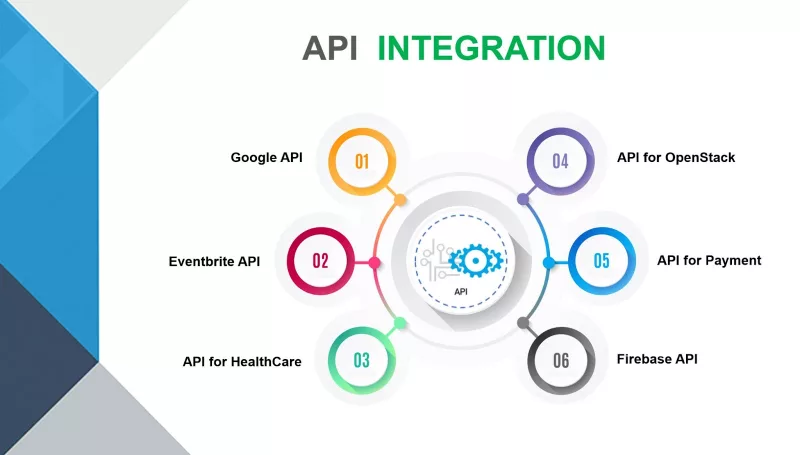

2. Tích Hợp Nhiều Nhà Cung Cấp (Multi-provider Strategy)

Không nên đặt tất cả trứng vào một giỏ. Việc tích hợp nhiều nhà cung cấp API cho các tác vụ khác nhau hoặc thậm chí cho cùng một tác vụ có thể mang lại lợi ích về chi phí và độ tin cậy. Ví dụ, bạn có thể dùng API của nhà cung cấp A cho các tác vụ khối lượng lớn, ít nhạy cảm về chất lượng (vì nó rẻ hơn), và nhà cung cấp B cho các tác vụ quan trọng, yêu cầu độ chính xác cao (dù đắt hơn). Điều này cũng giúp bạn có khả năng chuyển đổi (failover) sang nhà cung cấp khác nếu một dịch vụ gặp sự cố hoặc tăng giá đột ngột.

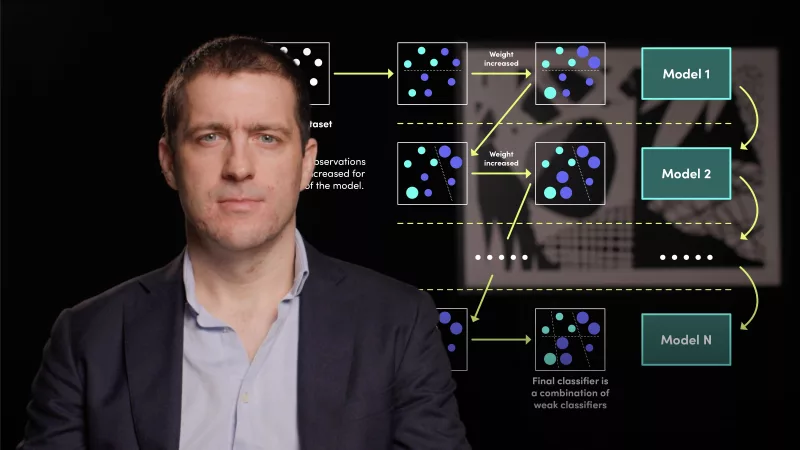

3. Fine-tuning Mô Hình Nhỏ Hơn

Nếu bạn có một lượng lớn dữ liệu tùy chỉnh, việc fine-tuning một mô hình nhỏ hơn (ví dụ: một phiên bản GPT-3.5 thay vì GPT-4) có thể mang lại hiệu suất tương đương với các mô hình lớn hơn cho tác vụ cụ thể của bạn, nhưng với chi phí inference thấp hơn đáng kể. Chi phí fine-tuning ban đầu có thể cao, nhưng nó có thể được bù đắp nhanh chóng nếu bạn có khối lượng sử dụng lớn.

4. Tận Dụng Các Gói Cam Kết (Committed Use Discounts)

Nếu bạn có khối lượng sử dụng API ổn định và dự kiến trong dài hạn, hãy xem xét các gói cam kết của nhà cung cấp. Các gói này thường cung cấp mức chiết khấu đáng kể so với giá pay-as-you-go thông thường, đổi lại việc bạn cam kết sử dụng một lượng tài nguyên nhất định trong một khoảng thời gian (ví dụ: 1 năm, 3 năm).

So Sánh Các Mô Hình Chi Phí và Đánh Giá Lợi Ích

Khi xem xét các API AI, chúng ta thường thấy hai mô hình chi phí chính: trả tiền theo mức sử dụng (pay-as-you-go) và các gói đăng ký/cam kết. Mô hình pay-as-you-go lý tưởng cho giai đoạn phát triển, thử nghiệm, hoặc các ứng dụng có mức sử dụng không đều, khó dự đoán. Nó mang lại sự linh hoạt tối đa nhưng thường có đơn giá cao nhất. Ngược lại, các gói đăng ký hoặc cam kết phù hợp cho các ứng dụng đã ổn định, có khối lượng sử dụng lớn và dự đoán được, mang lại mức chiết khấu đáng kể.

Ngoài ra, cần đánh giá lợi ích của việc "mua" dịch vụ AI so với việc "xây dựng" nó. Mua API AI giúp giảm đáng kể thời gian đưa ra thị trường, chi phí phát triển ban đầu, và gánh nặng quản lý cơ sở hạ tầng. Tuy nhiên, nó đi kèm với sự phụ thuộc vào nhà cung cấp và chi phí liên tục. Tự xây dựng (hoặc tự host mô hình mã nguồn mở) mang lại sự kiểm soát hoàn toàn và có thể rẻ hơn về lâu dài cho khối lượng cực lớn, nhưng đòi hỏi đầu tư lớn về kỹ năng, thời gian và tài nguyên.

Một phương pháp lai (hybrid approach) cũng rất phổ biến: sử dụng API cho các tác vụ phức tạp hoặc ít sử dụng, và tự host các mô hình mã nguồn mở cho các tác vụ cơ bản, khối lượng lớn. Ví dụ, dùng API của OpenAI cho việc tạo văn bản sáng tạo, nhưng dùng một mô hình BERT tự host cho việc phân loại văn bản đơn giản.

Các Lưu Ý Quan Trọng

- Bảo mật dữ liệu: Khi gửi dữ liệu nhạy cảm đến API của bên thứ ba, hãy luôn đảm bảo rằng bạn đã tuân thủ các quy định bảo mật (GDPR, HIPAA, v.v.) và đã đọc kỹ chính sách quyền riêng tư của nhà cung cấp.

- Độ trễ (Latency): Chi phí không chỉ là tiền bạc. Độ trễ của API có thể ảnh hưởng đến trải nghiệm người dùng. Hãy kiểm tra độ trễ thực tế trong môi trường của bạn và cân nhắc các vùng địa lý của máy chủ API.

- Giới hạn tốc độ (Rate Limits): Hầu hết các API đều có giới hạn số lượng yêu cầu trong một khoảng thời gian nhất định. Quản lý các giới hạn này là cần thiết để tránh lỗi và đảm bảo ứng dụng hoạt động ổn định.

- Quản lý lỗi: Triển khai các cơ chế xử lý lỗi mạnh mẽ (retry logic, exponential backoff) để ứng dụng của bạn có thể phục hồi gracefully khi API gặp sự cố tạm thời.

- Phiên bản API: Các nhà cung cấp thường xuyên cập nhật API và mô hình. Theo dõi các phiên bản mới và kế hoạch nâng cấp để tránh các thay đổi đột ngột có thể ảnh hưởng đến chi phí hoặc chức năng.

- Tài liệu và cộng đồng: Một API có tài liệu tốt và cộng đồng hỗ trợ mạnh mẽ có thể giúp giảm chi phí phát triển và khắc phục sự cố.

- Đánh giá định kỳ: Thị trường AI API thay đổi rất nhanh. Hãy định kỳ đánh giá lại các chiến lược của bạn, so sánh lại các nhà cung cấp và mô hình để đảm bảo bạn vẫn đang tối ưu chi phí AI API một cách hiệu quả nhất.

Câu Hỏi Thường Gặp

Làm thế nào để ước tính chi phí AI API trước khi triển khai?

Để ước tính chi phí, bạn cần xác định khối lượng sử dụng dự kiến (số lượng token, hình ảnh, giây âm thanh mỗi tháng), sau đó nhân với đơn giá của nhà cung cấp. Tận dụng các công cụ tính chi phí trên website của nhà cung cấp và các cấp độ miễn phí để có dữ liệu thực tế hơn. Luôn tính toán một khoản dự phòng cho sự tăng trưởng hoặc các trường hợp sử dụng ngoài dự kiến.

Có nên sử dụng nhiều API từ các nhà cung cấp khác nhau không?

Có, chiến lược đa nhà cung cấp (multi-provider strategy) có nhiều lợi ích. Nó giúp bạn tận dụng thế mạnh về giá cả và hiệu suất của từng nhà cung cấp cho các tác vụ cụ thể, giảm thiểu rủi ro phụ thuộc vào một nhà cung cấp duy nhất, và tạo điều kiện cho việc chuyển đổi linh hoạt nếu có sự thay đổi về giá hoặc dịch vụ.

Fine-tuning mô hình có thực sự tiết kiệm chi phí không?

Fine-tuning có thể tiết kiệm chi phí đáng kể trong dài hạn, đặc biệt đối với các ứng dụng có khối lượng sử dụng lớn và yêu cầu độ chính xác cao cho một miền dữ liệu cụ thể. Mặc dù có chi phí ban đầu cho việc fine-tuning, chi phí inference trên mỗi lần gọi thường thấp hơn nhiều so với việc sử dụng các mô hình lớn, tổng quát. Nó cũng giúp cải thiện chất lượng đầu ra, mang lại giá trị gia tăng.

Làm thế nào để giám sát chi phí API hiệu quả?

Bạn nên sử dụng các công cụ giám sát chi phí được cung cấp bởi nhà cung cấp dịch vụ cloud (như AWS Cost Explorer, Google Cloud Billing, Azure Cost Management). Ngoài ra, hãy thiết lập các cảnh báo chi phí và ngưỡng sử dụng để nhận thông báo khi chi tiêu vượt quá mức cho phép. Đối với các ứng dụng phức tạp, bạn có thể tích hợp các công cụ phân tích log và metric để theo dõi chi tiết hơn các lệnh gọi API.

Kết Luận

Việc tối ưu chi phí AI API không chỉ là một nhiệm vụ kỹ thuật mà còn là một quyết định chiến lược quan trọng. Bằng cách hiểu rõ cơ chế tính phí, lựa chọn nhà cung cấp thông minh, áp dụng các kỹ thuật quản lý sử dụng hiệu quả như caching, batch processing, giảm kích thước đầu vào và giám sát liên tục, các nhà phát triển và doanh nghiệp có thể khai thác tối đa sức mạnh của trí tuệ nhân tạo mà vẫn duy trì được hiệu quả về chi phí. Hy vọng bài viết này đã cung cấp cho bạn những kiến thức và công cụ cần thiết để đưa ra các quyết định sáng suốt trong hành trình phát triển AI của mình. Hãy tiếp tục theo dõi vibe coding để cập nhật những thông tin và hướng dẫn mới nhất về công nghệ.