Giới Thiệu Tối Ưu Hóa Multi-modal AI API: Chiến Lược Kết Hợp Cho Vibe Coding Hiệu Quả

Trong thế giới phát triển AI ngày càng năng động, việc tích hợp các mô hình trí tuệ nhân tạo vào ứng dụng đã trở thành một yếu tố then chốt để tạo ra trải nghiệm người dùng đột phá. Đặc biệt, sự xuất hiện của các multi-modal AI API đang mở ra những cánh cửa mới, cho phép các nhà phát triển xử lý và kết hợp thông tin từ nhiều dạng thức đầu vào khác nhau như văn bản, hình ảnh, âm thanh hay video. Bài viết này sẽ đi sâu vào các chiến lược tối ưu hóa và kết hợp hiệu quả các multi-modal AI API, giúp bạn khai thác tối đa sức mạnh của chúng trong các dự án vibe coding của mình.

Chúng ta sẽ khám phá cách các API này hoạt động, những thách thức thường gặp khi tích hợp chúng, và quan trọng nhất là các phương pháp tiếp cận thực tế để xây dựng các hệ thống AI mạnh mẽ, linh hoạt và có khả năng mở rộng. Mục tiêu cuối cùng là trang bị cho bạn kiến thức và công cụ cần thiết để không chỉ hiểu mà còn ứng dụng thành công multi-modal AI vào các giải pháp sáng tạo của riêng mình.

Multi-modal AI API: Khái Niệm và Tiềm Năng

Multi-modal AI là một lĩnh vực nghiên cứu và phát triển trong trí tuệ nhân tạo tập trung vào việc xử lý và hiểu dữ liệu từ nhiều phương thức (modalities) khác nhau. Thay vì chỉ phân tích văn bản, hình ảnh, hoặc âm thanh riêng lẻ, multi-modal AI có khả năng kết hợp thông tin từ tất cả các dạng thức này để đưa ra những hiểu biết sâu sắc và toàn diện hơn. Một multi-modal AI API là giao diện lập trình ứng dụng cho phép các nhà phát triển truy cập và sử dụng các mô hình AI có khả năng này mà không cần phải tự xây dựng từ đầu.

Tiềm năng của multi-modal AI là vô cùng lớn. Hãy tưởng tượng một trợ lý ảo không chỉ hiểu câu lệnh bằng giọng nói của bạn mà còn phân tích biểu cảm khuôn mặt qua camera và ngữ cảnh hình ảnh xung quanh để đưa ra phản hồi chính xác và phù hợp nhất. Hoặc một hệ thống chăm sóc khách hàng có thể phân tích cả đoạn chat, hình ảnh sản phẩm do khách hàng gửi, và đoạn ghi âm cuộc gọi để chẩn đoán vấn đề một cách nhanh chóng và hiệu quả. Các ứng dụng trong y tế (chẩn đoán bệnh dựa trên hình ảnh y tế và bệnh án), giáo dục (phản hồi cá nhân hóa dựa trên cách học sinh tương tác), giải trí (tạo nội dung đa phương tiện) đều đang được cách mạng hóa bởi công nghệ này.

Các API này thường cung cấp các điểm cuối (endpoints) khác nhau cho từng tác vụ cụ thể hoặc một điểm cuối tổng hợp có khả năng xử lý nhiều loại đầu vào. Ví dụ, một API có thể có một endpoint để phân tích cảm xúc từ văn bản, một endpoint khác để nhận diện đối tượng trong hình ảnh, và một endpoint thứ ba để chuyển đổi giọng nói thành văn bản. Khi kết hợp các khả năng này, chúng ta có thể xây dựng các ứng dụng phức tạp hơn nhiều so với việc chỉ sử dụng AI đơn phương thức.

Thách thức chính khi làm việc với multi-modal AI API là sự phức tạp trong việc quản lý dữ liệu đa dạng, đồng bộ hóa các đầu vào, và diễn giải các kết quả từ các mô hình khác nhau. Điều này đòi hỏi một chiến lược tích hợp cẩn thận và kiến trúc hệ thống được thiết kế tốt để đảm bảo hiệu suất và độ tin cậy. Chính vì vậy, việc tối ưu hóa cách chúng ta tương tác với các API này là cực kỳ quan trọng.

Chiến Lược Tích Hợp và Tối Ưu Hóa Multi-modal AI API

Để tích hợp và tối ưu hóa multi-modal AI API một cách hiệu quả, chúng ta cần áp dụng một số chiến lược cốt lõi. Đầu tiên là việc hiểu rõ các API mà bạn đang sử dụng. Mỗi nhà cung cấp (Google Cloud AI, AWS AI, OpenAI, v.v.) có thể có cách triển khai và đặc điểm riêng. Đọc kỹ tài liệu API (API documentation) là bước không thể thiếu.

1. Chuẩn Bị Dữ Liệu Đầu Vào (Data Preprocessing)

Dữ liệu là trái tim của mọi hệ thống AI. Đối với multi-modal AI, việc chuẩn bị dữ liệu đầu vào sao cho phù hợp với yêu cầu của từng API là cực kỳ quan trọng. Điều này bao gồm:

- Định dạng hóa (Formatting): Đảm bảo dữ liệu hình ảnh ở định dạng

JPG,PNG; âm thanh ởWAV,MP3; văn bản ởUTF-8, v.v. - Kích thước và Chất lượng (Size and Quality): Nhiều API có giới hạn về kích thước file hoặc độ phân giải. Cần nén hình ảnh, giảm bitrate âm thanh nếu cần thiết mà vẫn giữ được chất lượng đủ dùng.

- Đồng bộ hóa (Synchronization): Khi kết hợp các modal, đảm bảo chúng được đồng bộ về thời gian hoặc ngữ cảnh. Ví dụ, một đoạn âm thanh và hình ảnh liên quan đến cùng một khoảnh khắc.

- Tiền xử lý cụ thể (Specific Preprocessing): Ví dụ, cắt bỏ khoảng lặng trong âm thanh, làm sạch văn bản (loại bỏ ký tự đặc biệt, chuyển về chữ thường), hoặc tiền xử lý hình ảnh (resize, crop, normalize).

Ví dụ về tiền xử lý hình ảnh trước khi gửi lên API:

from PIL import Image

import io

def preprocess_image(image_path, max_size=(1024, 768), quality=85):

try:

img = Image.open(image_path)

img.thumbnail(max_size, Image.LANCZOS) # Resize to fit max_size

img_byte_arr = io.BytesIO()

img.save(img_byte_arr, format='JPEG', quality=quality)

return img_byte_arr.getvalue()

except Exception as e:

print(f"Error processing image: {e}")

return None

# Cách sử dụng

# processed_image_bytes = preprocess_image("path/to/your/image.jpg")

# if processed_image_bytes:

# # Gửi processed_image_bytes lên multi-modal AI API2. Lựa Chọn API Phù Hợp và Kết Hợp Thông Minh

Không phải tất cả các multi-modal AI API đều được tạo ra như nhau. Một số có thể mạnh về xử lý ngôn ngữ tự nhiên (NLP), trong khi số khác lại xuất sắc trong nhận diện hình ảnh hoặc tổng hợp giọng nói. Việc lựa chọn API phù hợp với từng tác vụ cụ thể là rất quan trọng. Thay vì cố gắng tìm một API "tất cả trong một" có thể không tồn tại hoặc không tối ưu, hãy cân nhắc kết hợp nhiều API chuyên biệt.

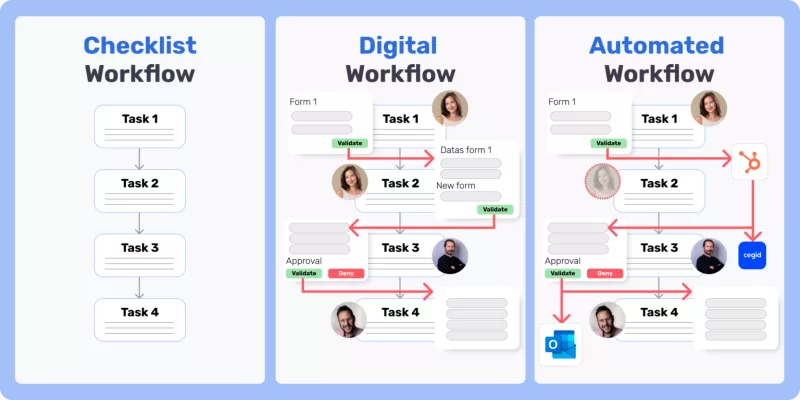

Chiến lược kết hợp:

- Pipeline nối tiếp (Sequential Pipeline): Đầu ra của một API trở thành đầu vào của API khác. Ví dụ: Speech-to-Text API -> Text Sentiment Analysis API.

- Kết hợp song song (Parallel Fusion): Gửi các modal khác nhau đến các API chuyên biệt cùng lúc, sau đó tổng hợp kết quả. Ví dụ: Gửi hình ảnh đến Object Detection API và văn bản mô tả đến Text Entity Extraction API, sau đó kết hợp các entity và đối tượng được phát hiện.

- Sử dụng API tổng hợp (Integrated Multi-modal API): Một số nhà cung cấp đã bắt đầu cung cấp các API có khả năng xử lý đa phương thức ngay trong một lời gọi. Ví dụ, một API có thể nhận cả hình ảnh và văn bản để thực hiện VQA (Visual Question Answering).

Việc kết hợp này cho phép chúng ta tận dụng điểm mạnh của từng dịch vụ, tạo ra một hệ thống mạnh mẽ và linh hoạt hơn. Tuy nhiên, điều này cũng đòi hỏi quản lý phức tạp hơn về API keys, rate limits và xử lý lỗi.

3. Xử Lý Lỗi và Cơ Chế Retry (Error Handling & Retry Mechanisms)

Khi làm việc với các dịch vụ bên ngoài, đặc biệt là các multi-modal AI API, lỗi là điều không thể tránh khỏi. Các lỗi có thể đến từ nhiều nguyên nhân: giới hạn tốc độ (rate limiting), lỗi xác thực (authentication errors), lỗi mạng (network issues), hoặc lỗi xử lý dữ liệu. Một chiến lược xử lý lỗi mạnh mẽ là cần thiết.

- Xử lý lỗi cụ thể: Bắt các loại lỗi HTTP status code khác nhau (4xx, 5xx) và phản ứng tương ứng.

- Cơ chế Retry với Exponential Backoff: Khi gặp lỗi tạm thời (ví dụ:

429 Too Many Requestshoặc5xx Server Error), không nên thử lại ngay lập tức. Thay vào đó, hãy đợi một khoảng thời gian ngắn và tăng dần khoảng thời gian chờ giữa các lần thử lại.

Ví dụ về cơ chế retry trong Python:

import requests

import time

def call_ai_api_with_retry(endpoint, data, max_retries=5, initial_delay=1):

for i in range(max_retries):

try:

response = requests.post(endpoint, json=data)

response.raise_for_status() # Raise HTTPError for bad responses (4xx or 5xx)

return response.json()

except requests.exceptions.HTTPError as e:

if response.status_code == 429 or response.status_code >= 500:

delay = initial_delay * (2 ** i)

print(f"API call failed with {response.status_code}. Retrying in {delay} seconds...")

time.sleep(delay)

else:

print(f"Non-retryable error: {e}")

raise

except requests.exceptions.RequestException as e:

print(f"Network error or other request issue: {e}")

delay = initial_delay * (2 ** i)

print(f"Retrying in {delay} seconds...")

time.sleep(delay)

raise Exception(f"Failed after {max_retries} retries.")

# Cách sử dụng

# api_endpoint = "https://your-multi-modal-ai-api.com/process"

# payload = {"text": "Hello world", "image_url": "..."}

# try:

# result = call_ai_api_with_retry(api_endpoint, payload)

# print("API Result:", result)

# except Exception as e:

# print("Final failure:", e)4. Tối Ưu Hóa Chi Phí và Hiệu Suất

Các multi-modal AI API thường tính phí dựa trên lượng sử dụng (số lượng request, dung lượng dữ liệu xử lý, v.v.). Việc tối ưu hóa chi phí là rất quan trọng, đặc biệt với các ứng dụng có quy mô lớn.

- Caching: Đối với các yêu cầu lặp lại hoặc dữ liệu ít thay đổi, hãy cân nhắc lưu trữ kết quả API trong cache.

- Batching: Nếu API cho phép, hãy nhóm nhiều yêu cầu nhỏ thành một yêu cầu lớn hơn để giảm số lượng cuộc gọi API và đôi khi giảm chi phí.

- Giảm thiểu dữ liệu: Chỉ gửi phần dữ liệu cần thiết nhất. Ví dụ, nếu chỉ cần phân tích một phần văn bản, đừng gửi toàn bộ tài liệu.

- Giám sát (Monitoring): Theo dõi chặt chẽ việc sử dụng API để phát hiện và điều chỉnh các mẫu sử dụng không hiệu quả.

Best Practices cho Vibe Coding với Multi-modal AI

Để thực sự làm chủ việc sử dụng các multi-modal AI API trong các dự án vibe coding, có một số best practices mà bạn nên tuân thủ.

1. Thiết Kế Kiến Trúc Module Hóa

Khi tích hợp nhiều multi-modal AI API, hệ thống của bạn có thể nhanh chóng trở nên phức tạp. Hãy thiết kế kiến trúc theo hướng module hóa, nơi mỗi phần xử lý một loại modal hoặc một tác vụ AI cụ thể. Điều này giúp dễ dàng bảo trì, mở rộng và thay thế các thành phần khi cần thiết. Ví dụ, bạn có thể có một module chuyên xử lý hình ảnh, một module khác cho văn bản, và một module tổng hợp kết quả.

2. Đánh Giá và Lựa Chọn Các Feature Cần Thiết

Mỗi multi-modal AI API thường cung cấp một loạt các tính năng (features). Đừng cố gắng sử dụng tất cả mọi thứ nếu không cần thiết. Đánh giá cẩn thận các yêu cầu của ứng dụng và chỉ kích hoạt những tính năng thực sự mang lại giá trị. Điều này không chỉ giúp giảm chi phí mà còn tăng tốc độ xử lý và giảm độ phức tạp của hệ thống.

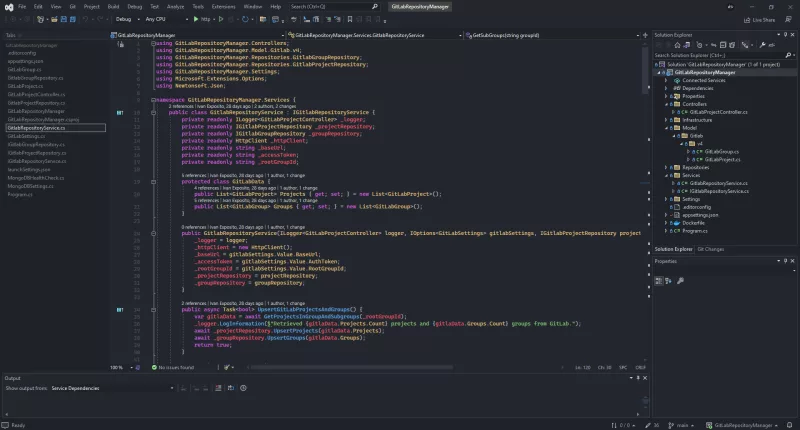

3. Xây Dựng Lớp Trừu Tượng (Abstraction Layer)

Để linh hoạt hơn, đặc biệt khi bạn có thể cần chuyển đổi giữa các nhà cung cấp API khác nhau trong tương lai, hãy xây dựng một lớp trừu tượng (abstraction layer) cho các cuộc gọi API. Thay vì gọi trực tiếp API của Google, AWS hay OpenAI trong code ứng dụng, hãy tạo ra các hàm wrapper của riêng bạn. Điều này giúp cô lập logic gọi API và dễ dàng thay đổi nhà cung cấp mà không ảnh hưởng lớn đến phần còn lại của ứng dụng.

# Ví dụ về abstraction layer đơn giản

class MultiModalService:

def __init__(self, provider="openai"):

self.provider = provider

if provider == "openai":

import openai

self.client = openai.OpenAI()

elif provider == "google":

# self.client = GoogleAIClient()

pass # Placeholder for Google AI

else:

raise ValueError("Unsupported AI provider")

def analyze_image_and_text(self, image_data, text_data):

if self.provider == "openai":

# Logic gọi OpenAI API

try:

response = self.client.chat.completions.create(

model="gpt-4o",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": text_data},

{

"type": "image_url",

"image_url": {"url": f"data:image/jpeg;base64,{image_data.decode('utf-8')}", "detail": "high"},

},

],

}

],

max_tokens=300,

)

return response.choices[0].message.content

except Exception as e:

print(f"OpenAI API error: {e}")

return None

elif self.provider == "google":

# Logic gọi Google AI API

return "Google AI analysis result"

return "Unknown analysis result"

# Cách sử dụng

# image_bytes = preprocess_image("path/to/image.jpg")

# if image_bytes:

# import base64

# base64_image = base64.b64encode(image_bytes)

#

# service = MultiModalService(provider="openai")

# result = service.analyze_image_and_text(base64_image, "Describe this image and identify objects.")

# print(result)4. Giám Sát và Phân Tích Hiệu Suất

Việc theo dõi hiệu suất của các multi-modal AI API là rất quan trọng. Sử dụng các công cụ giám sát để theo dõi thời gian phản hồi (latency), tỷ lệ lỗi (error rates), và mức độ sử dụng tài nguyên. Điều này giúp bạn nhanh chóng phát hiện các vấn đề, tối ưu hóa các điểm nghẽn và đảm bảo trải nghiệm người dùng mượt mà.

So Sánh Các Multi-modal AI API Phổ Biến

Thị trường multi-modal AI API đang phát triển nhanh chóng với sự tham gia của nhiều ông lớn công nghệ. Mỗi nền tảng có những ưu và nhược điểm riêng, phù hợp với các trường hợp sử dụng khác nhau.

- OpenAI (GPT-4o, GPT-V): Nổi bật với khả năng hiểu ngữ cảnh mạnh mẽ và sinh nội dung đa dạng. GPT-4o đặc biệt ấn tượng với khả năng xử lý đồng thời văn bản, hình ảnh và âm thanh, cho phép các tương tác phức tạp như phân tích biểu đồ, mô tả video, hoặc tạo nội dung từ nhiều đầu vào. Điểm mạnh là sự linh hoạt và khả năng sáng tạo, nhưng chi phí có thể cao hơn đối với các tác vụ đơn giản.

- Google Cloud AI (Vision AI, Speech-to-Text, Natural Language AI, Gemini API): Cung cấp một bộ API toàn diện với độ chính xác cao và khả năng mở rộng tốt. Gemini API là một bước tiến lớn của Google trong multi-modal, tích hợp sâu vào hệ sinh thái của họ. Các API của Google thường có hiệu suất cao trong các tác vụ chuyên biệt như nhận diện đối tượng, chuyển đổi giọng nói hay phân tích cú pháp. Phù hợp cho các doanh nghiệp lớn với nhu cầu tùy chỉnh và tích hợp sâu.

- AWS AI (Rekognition, Polly, Transcribe, Comprehend): AWS cung cấp các dịch vụ AI riêng lẻ cho từng modal, cho phép xây dựng các hệ thống multi-modal bằng cách kết hợp chúng. Ví dụ, dùng Rekognition cho hình ảnh, Transcribe cho âm thanh và Comprehend cho văn bản. Ưu điểm là sự linh hoạt và khả năng kiểm soát chi tiết, cùng với hệ sinh thái AWS rộng lớn. Tuy nhiên, việc kết hợp có thể đòi hỏi nhiều công sức tích hợp hơn.

Khi lựa chọn, hãy cân nhắc các yếu tố như độ chính xác cần thiết, chi phí, khả năng mở rộng, dễ dàng tích hợp, và các tính năng cụ thể mà dự án của bạn yêu cầu. Đôi khi, việc sử dụng một API cho một tác vụ và một API khác cho tác vụ còn lại có thể là lựa chọn tối ưu nhất.

Các Lưu Ý Quan Trọng

- Bảo Mật Dữ Liệu: Khi gửi dữ liệu nhạy cảm đến các multi-modal AI API, luôn đảm bảo rằng bạn tuân thủ các quy định bảo mật (GDPR, HIPAA, v.v.) và hiểu rõ cách nhà cung cấp API xử lý dữ liệu của bạn. Sử dụng mã hóa (encryption) cho dữ liệu truyền tải và lưu trữ.

- Giới Hạn Tốc Độ (Rate Limiting): Hầu hết các API đều có giới hạn số lượng yêu cầu trong một khoảng thời gian nhất định. Đảm bảo ứng dụng của bạn có cơ chế xử lý giới hạn này để tránh bị chặn.

- Chi Phí Phát Sinh: Multi-modal AI API có thể khá đắt đỏ nếu không được tối ưu hóa. Luôn theo dõi chi phí và cân nhắc các chiến lược caching, batching để giảm thiểu.

- Độ Trễ (Latency): Việc gọi API qua mạng luôn có độ trễ. Đối với các ứng dụng yêu cầu phản hồi thời gian thực, hãy cân nhắc kiến trúc pipeline song song hoặc xử lý dữ liệu tiền cục bộ (local preprocessing) để giảm thiểu độ trễ.

- Kiểm Tra và Đánh Giá Liên Tục: Hiệu suất của các mô hình AI có thể thay đổi theo thời gian. Thường xuyên kiểm tra và đánh giá kết quả từ API để đảm bảo chúng vẫn đáp ứng yêu cầu chất lượng.

- Độc Lập Nhà Cung Cấp: Cố gắng thiết kế hệ thống sao cho không bị khóa chặt vào một nhà cung cấp duy nhất. Lớp trừu tượng (abstraction layer) giúp bạn dễ dàng chuyển đổi nếu cần.

- Xử Lý Dữ Liệu Biên (Edge Cases): Các mô hình AI có thể gặp khó khăn với dữ liệu bất thường hoặc không rõ ràng. Xây dựng logic để xử lý các trường hợp biên này một cách duyên dáng, có thể bằng cách yêu cầu người dùng cung cấp thêm thông tin hoặc sử dụng các heuristic dự phòng.

Câu Hỏi Thường Gặp

Multi-modal AI API khác gì so với các AI API truyền thống?

Multi-modal AI API có khả năng xử lý và kết hợp thông tin từ nhiều dạng thức dữ liệu (văn bản, hình ảnh, âm thanh, video) trong một lần gọi API hoặc thông qua việc phối hợp các API chuyên biệt, trong khi các AI API truyền thống thường chỉ tập trung vào một dạng thức dữ liệu duy nhất (ví dụ: chỉ xử lý văn bản hoặc chỉ xử lý hình ảnh).

Làm thế nào để chọn multi-modal AI API phù hợp cho dự án của tôi?

Bạn nên xem xét các yếu tố như loại dữ liệu bạn cần xử lý, độ chính xác yêu cầu, chi phí, khả năng mở rộng, tài liệu API và sự hỗ trợ từ nhà cung cấp. Đừng ngại thử nghiệm với các API khác nhau để tìm ra giải pháp tối ưu nhất cho trường hợp sử dụng cụ thể của mình.

Có cần kiến thức chuyên sâu về Machine Learning để sử dụng multi-modal AI API không?

Không nhất thiết. Một trong những lợi ích lớn nhất của multi-modal AI API là chúng trừu tượng hóa sự phức tạp của các mô hình Machine Learning. Bạn chỉ cần hiểu cách gửi dữ liệu đầu vào và xử lý kết quả trả về, giống như việc sử dụng bất kỳ API RESTful nào khác, mà không cần phải xây dựng hay huấn luyện mô hình từ đầu.

Làm thế nào để quản lý chi phí khi sử dụng multi-modal AI API?

Để quản lý chi phí, bạn có thể áp dụng các chiến lược như caching kết quả, nhóm các yêu cầu (batching) khi API cho phép, chỉ gửi lượng dữ liệu cần thiết, và thường xuyên giám sát mức độ sử dụng API của mình để phát hiện và tối ưu hóa các mẫu sử dụng không hiệu quả.

Multi-modal AI API có thể được sử dụng trong các ứng dụng thời gian thực không?

Có, nhưng cần có chiến lược tối ưu hóa cẩn thận. Việc xử lý dữ liệu tiền cục bộ (local preprocessing), sử dụng các API có độ trễ thấp và triển khai kiến trúc không đồng bộ có thể giúp giảm thiểu độ trễ và làm cho các ứng dụng thời gian thực trở nên khả thi.

Kết Luận

Tối ưu hóa và kết hợp các multi-modal AI API là một kỹ năng thiết yếu trong bối cảnh phát triển ứng dụng thông minh hiện nay. Bằng cách áp dụng các chiến lược về chuẩn bị dữ liệu, lựa chọn API thông minh, xử lý lỗi mạnh mẽ và tối ưu hóa chi phí, bạn có thể xây dựng các hệ thống AI mạnh mẽ, linh hoạt và mang lại giá trị thực sự.

Hy vọng bài viết này đã cung cấp cho bạn một cái nhìn toàn diện và những công cụ cần thiết để bắt đầu hành trình vibe coding của mình với multi-modal AI. Hãy nhớ rằng, chìa khóa nằm ở sự thử nghiệm, học hỏi liên tục và khả năng thích ứng với những tiến bộ không ngừng của công nghệ AI. Chúc bạn thành công trong việc kiến tạo những giải pháp đột phá!