Hậu trường AI: Xây dựng AI Gateway đa kênh tăng tốc dự án Vibe Coding

Chào mừng các bạn đến với một bài viết chuyên sâu về một trong những công nghệ cốt lõi đang giúp các dự án AI của chúng ta tại vibe coding tăng tốc vượt bậc: AI Gateway đa kênh. Trong bối cảnh phát triển AI ngày càng nhanh chóng, việc quản lý và tích hợp nhiều mô hình AI từ các nhà cung cấp khác nhau trở thành một thách thức không nhỏ. Bài viết này sẽ giúp bạn hiểu rõ về AI Gateway API, cách chúng ta xây dựng và tận dụng nó để tối ưu hóa quy trình phát triển, giảm thiểu rủi ro và tăng cường hiệu quả cho mọi dự án. Từ việc định nghĩa khái niệm cơ bản đến những ví dụ code thực tế, chúng ta sẽ cùng nhau khám phá hành trình biến một ý tưởng phức tạp thành một giải pháp mạnh mẽ, linh hoạt và dễ mở rộng. Hãy cùng đi sâu vào thế giới hậu trường của AI!

AI Gateway API: Cánh cửa thông minh cho hệ sinh thái AI

Trong kỷ nguyên AI, các doanh nghiệp và nhà phát triển ngày càng phụ thuộc vào nhiều mô hình trí tuệ nhân tạo từ các nhà cung cấp khác nhau như OpenAI, Google Gemini, Anthropic Claude, và nhiều dịch vụ khác. Mỗi nhà cung cấp lại có API riêng biệt, cơ chế xác thực khác nhau, giới hạn tốc độ (rate limiting) và cách xử lý lỗi không đồng nhất. Việc tích hợp trực tiếp từng API này vào ứng dụng có thể dẫn đến một "mớ bòng bong" về code, khó quản lý, khó mở rộng và tốn kém thời gian. Đây chính là lúc AI Gateway API phát huy vai trò của mình.

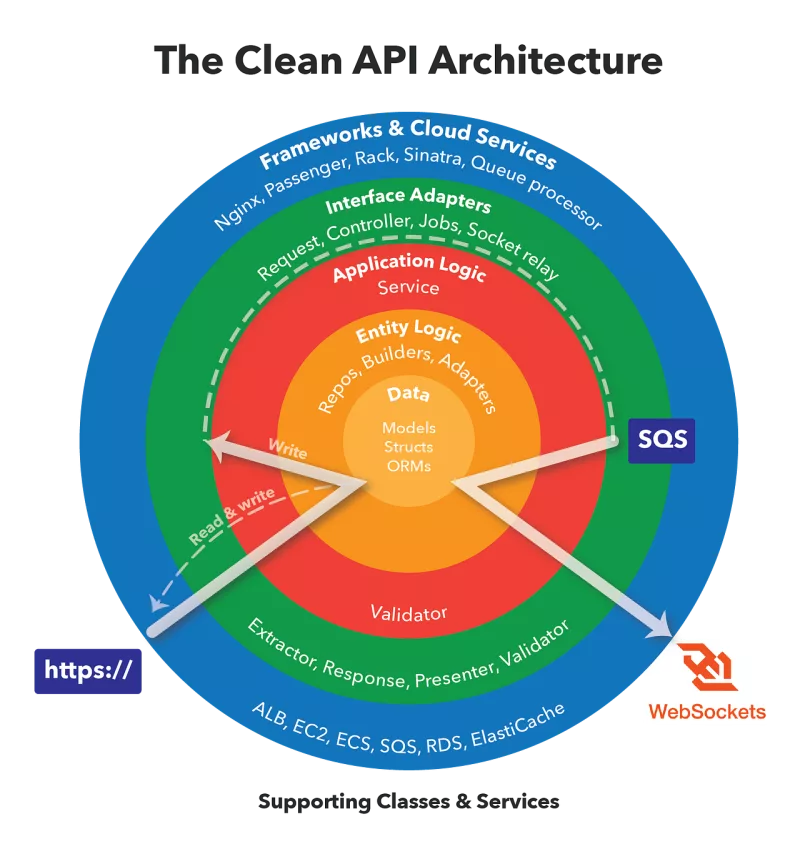

Một AI Gateway API về cơ bản là một lớp trừu tượng (abstraction layer) đứng giữa ứng dụng của bạn và các nhà cung cấp mô hình AI. Nó hoạt động như một điểm truy cập duy nhất, cho phép ứng dụng của bạn giao tiếp với bất kỳ mô hình AI nào thông qua một giao diện API nhất quán. Thay vì phải viết code riêng cho từng API của OpenAI, Google, hay Anthropic, bạn chỉ cần gọi đến API của Gateway. Gateway sẽ đảm nhiệm việc định tuyến yêu cầu, chuyển đổi định dạng, xử lý xác thực, quản lý rate limiting, và thậm chí là caching hoặc chuyển đổi dự phòng (failover) giữa các nhà cung cấp.

Lợi ích chính của việc sử dụng AI Gateway API bao gồm: đơn giản hóa việc tích hợp (bạn chỉ cần học một API duy nhất), tăng cường khả năng mở rộng (dễ dàng thêm hoặc thay đổi nhà cung cấp AI mà không ảnh hưởng đến ứng dụng), cải thiện khả năng quản lý (tập trung hóa việc giám sát, logging, và bảo mật), và tối ưu hóa chi phí (thông qua cơ chế caching, lựa chọn nhà cung cấp tối ưu dựa trên giá cả/hiệu suất). Đối với vibe coding, một AI Gateway API đa kênh là chìa khóa để chúng tôi duy trì sự linh hoạt và đổi mới trong các sản phẩm AI của mình.

Xây dựng AI Gateway đa kênh: Từ ý tưởng đến triển khai

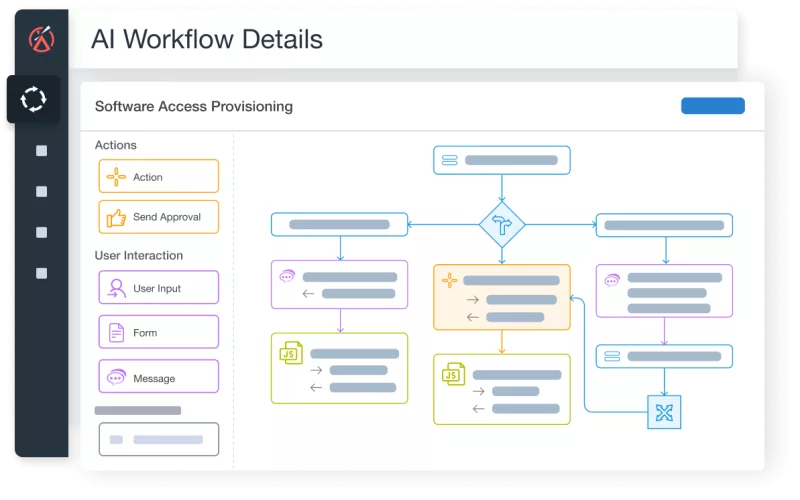

Để xây dựng một AI Gateway API đa kênh hiệu quả, chúng ta cần xem xét một số thành phần cốt lõi. Đầu tiên là một RESTful API endpoint duy nhất mà các ứng dụng client sẽ gọi đến. Tiếp theo là một bộ định tuyến (router) thông minh để xác định nhà cung cấp AI nào sẽ xử lý yêu cầu. Sau đó là các adapter cho từng nhà cung cấp AI, chịu trách nhiệm chuyển đổi yêu cầu và phản hồi sang định dạng tương thích với API của họ. Cuối cùng, không thể thiếu các cơ chế về xác thực, quản lý lỗi, logging, và giám sát.

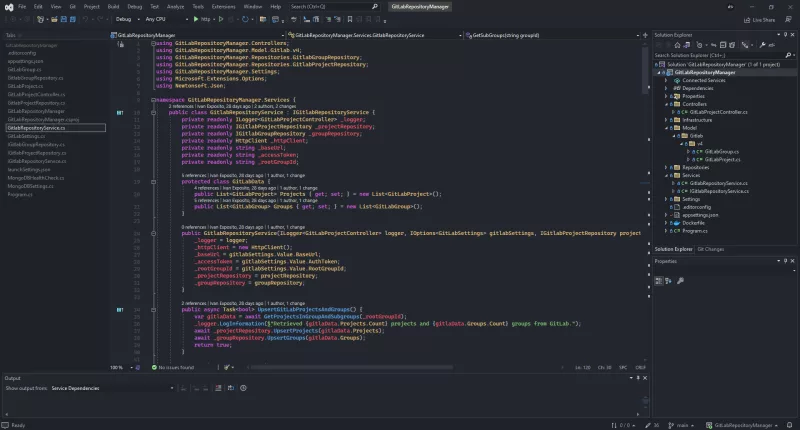

Chúng ta có thể bắt đầu với một kiến trúc đơn giản sử dụng Node.js và Express.js. Một ví dụ cơ bản về cách xử lý yêu cầu và định tuyến có thể như sau. Giả sử chúng ta có một endpoint /v1/chat/completions mà client sẽ gọi đến, và trong payload của yêu cầu, client có thể chỉ định provider (ví dụ: "openai", "google", "anthropic").

const express = require('express');

const bodyParser = require('body-parser');

const axios = require('axios'); // Dùng để gọi các API ngoại vi

const app = express();

const PORT = process.env.PORT || 3000;

app.use(bodyParser.json());

// Các hàm adapter cho từng nhà cung cấp AI

async function callOpenAI(payload) {

// Chuyển đổi payload sang định dạng OpenAI

const openaiPayload = {

model: payload.model || 'gpt-3.5-turbo',

messages: payload.messages,

temperature: payload.temperature || 0.7

};

try {

const response = await axios.post('https://api.openai.com/v1/chat/completions', openaiPayload, {

headers: {

'Authorization': `Bearer ${process.env.OPENAI_API_KEY}`,

'Content-Type': 'application/json'

}

});

return response.data;

} catch (error) {

console.error('Error calling OpenAI:', error.response ? error.response.data : error.message);

throw new Error('Failed to call OpenAI API');

}

}

async function callGoogleGemini(payload) {

// Chuyển đổi payload sang định dạng Google Gemini

// Lưu ý: API Gemini có thể có cấu trúc khác OpenAI

const geminiPayload = {

contents: payload.messages.map(msg => ({

role: msg.role === 'user' ? 'user' : 'model', // Gemini dùng 'user'/'model'

parts: [{ text: msg.content }]

})),

generationConfig: {

temperature: payload.temperature || 0.7

}

};

try {

const response = await axios.post(`https://generativelanguage.googleapis.com/v1beta/models/${payload.model || 'gemini-pro'}:generateContent?key=${process.env.GOOGLE_API_KEY}`, geminiPayload, {

headers: {

'Content-Type': 'application/json'

}

});

// Chuyển đổi phản hồi Gemini về định dạng tương tự OpenAI

return {

id: response.data.candidates[0].index,

choices: [{

message: {

role: 'assistant',

content: response.data.candidates[0].content.parts[0].text

}

}],

model: payload.model || 'gemini-pro'

};

} catch (error) {

console.error('Error calling Google Gemini:', error.response ? error.response.data : error.message);

throw new Error('Failed to call Google Gemini API');

}

}

// Endpoint chính của Gateway

app.post('/v1/chat/completions', async (req, res) => {

const { provider, ...payload } = req.body;

if (!provider) {

return res.status(400).json({ error: 'Provider is required' });

}

try {

let result;

switch (provider.toLowerCase()) {

case 'openai':

result = await callOpenAI(payload);

break;

case 'google':

case 'gemini':

result = await callGoogleGemini(payload);

break;

// Thêm các case khác cho Anthropic, Cohere, v.v.

default:

return res.status(400).json({ error: `Unsupported AI provider: ${provider}` });

}

res.json(result);

} catch (error) {

res.status(500).json({ error: error.message });

}

});

app.listen(PORT, () => {

console.log(`AI Gateway API running on port ${PORT}`);

});

Đoạn code trên minh họa một cách đơn giản về cách định tuyến yêu cầu dựa trên trường provider trong payload. Mỗi hàm callXxx() sẽ là một adapter riêng, chịu trách nhiệm giao tiếp với API của nhà cung cấp tương ứng. Điều quan trọng ở đây là AI Gateway API không chỉ đơn thuần là proxy. Nó còn phải thực hiện việc chuyển đổi định dạng yêu cầu đầu vào (từ client) sang định dạng mà nhà cung cấp AI mong muốn, và ngược lại, chuyển đổi phản hồi từ nhà cung cấp AI về một định dạng chuẩn mà client của Gateway có thể dễ dàng xử lý. Điều này đòi hỏi sự hiểu biết sâu sắc về các API của từng nhà cung cấp và khả năng thiết kế một định dạng chuẩn hóa nội bộ.

Tối ưu hóa và các tính năng nâng cao cho AI Gateway

Một AI Gateway API thực thụ không chỉ dừng lại ở việc định tuyến. Để nó trở thành một công cụ mạnh mẽ, chúng ta cần tích hợp thêm nhiều tính năng nâng cao. Một trong số đó là quản lý khóa API (API Key Management) tập trung. Thay vì mỗi ứng dụng phải quản lý riêng các khóa API của từng nhà cung cấp, Gateway có thể lưu trữ chúng một cách an toàn và tự động thêm vào các yêu cầu gửi đi. Điều này tăng cường bảo mật và đơn giản hóa việc luân chuyển khóa.

Cơ chế Retry và Failover là cực kỳ quan trọng. Khi một nhà cung cấp AI gặp sự cố hoặc trả về lỗi tạm thời, Gateway có thể tự động thử lại yêu cầu hoặc chuyển hướng yêu cầu đó sang một nhà cung cấp AI khác (nếu cấu hình). Điều này giúp tăng cường độ tin cậy và tính sẵn sàng của hệ thống. Ví dụ, nếu OpenAI đang bị quá tải, Gateway có thể tự động gửi yêu cầu tương tự đến Google Gemini.

Quản lý Rate Limiting là một tính năng không thể thiếu. Mỗi nhà cung cấp AI đều có giới hạn về số lượng yêu cầu mà bạn có thể gửi trong một khoảng thời gian nhất định. Gateway có thể theo dõi và áp dụng các giới hạn này, hoặc thậm chí triển khai rate limiting tùy chỉnh cho từng client của Gateway, ngăn chặn việc một ứng dụng duy nhất làm quá tải toàn bộ hệ thống. Caching cũng là một cách hiệu quả để giảm tải cho các API AI và tăng tốc độ phản hồi cho các yêu cầu lặp lại.

// Ví dụ về cách tích hợp retry và failover (cần thư viện như 'p-retry' hoặc tự xây dựng)

async function callAIWithRetryAndFailover(provider, payload, maxRetries = 3) {

const providers = {

'openai': callOpenAI,

'google': callGoogleGemini,

// ... các providers khác

};

const preferredProvider = providers[provider.toLowerCase()];

const fallbackProviders = Object.keys(providers).filter(p => p !== provider.toLowerCase()).map(p => providers[p]);

let lastError = null;

// Thử nhà cung cấp ưu tiên

for (let i = 0; i <= maxRetries; i++) {

try {

console.log(`Attempt ${i + 1} with preferred provider: ${provider}`);

return await preferredProvider(payload);

} catch (error) {

lastError = error;

if (i < maxRetries) {

console.warn(`Preferred provider ${provider} failed. Retrying...`);

await new Promise(resolve => setTimeout(resolve, 1000 * (i + 1))); // Exponential backoff

}

}

}

// Nếu nhà cung cấp ưu tiên thất bại sau nhiều lần thử, chuyển sang fallback

if (fallbackProviders.length > 0) {

console.warn(`Preferred provider ${provider} failed after ${maxRetries + 1} attempts. Trying fallback providers.`);

for (const fallbackCall of fallbackProviders) {

try {

console.log(`Trying fallback provider: ${fallbackCall.name}`); // Giả sử tên hàm là tên provider

return await fallbackCall(payload);

} catch (error) {

console.warn(`Fallback provider ${fallbackCall.name} also failed.`);

lastError = error;

}

}

}

throw lastError || new Error('All AI providers failed.');

}

// Trong endpoint:

app.post('/v1/chat/completions', async (req, res) => {

const { provider, ...payload } = req.body;

// ... kiểm tra provider ...

try {

const result = await callAIWithRetryAndFailover(provider, payload);

res.json(result);

} catch (error) {

res.status(500).json({ error: error.message });

}

});

Ngoài ra, Logging và Monitoring là cực kỳ quan trọng. Gateway nên ghi lại mọi yêu cầu và phản hồi, bao gồm thời gian phản hồi, trạng thái lỗi, và chi phí ước tính. Điều này giúp gỡ lỗi, phân tích hiệu suất và tối ưu hóa chi phí. Các công cụ giám sát như Prometheus và Grafana có thể được tích hợp để theo dõi sức khỏe và hiệu suất của Gateway theo thời gian thực.

Phân tích và Đánh giá các phương pháp triển khai AI Gateway

Có nhiều cách để triển khai một AI Gateway API, từ việc tự xây dựng (self-hosted) đến sử dụng các dịch vụ có sẵn của bên thứ ba. Mỗi phương pháp đều có ưu và nhược điểm riêng.

Tự xây dựng (Self-hosted AI Gateway):

- Ưu điểm: Kiểm soát hoàn toàn về kiến trúc, tính năng, bảo mật và khả năng tùy chỉnh. Có thể tối ưu hóa cho các trường hợp sử dụng cụ thể của doanh nghiệp. Không phụ thuộc vào nhà cung cấp bên thứ ba.

- Nhược điểm: Đòi hỏi nguồn lực phát triển và bảo trì đáng kể. Cần kiến thức chuyên sâu về quản lý cơ sở hạ tầng, bảo mật và khả năng mở rộng. Chi phí vận hành có thể cao nếu không được tối ưu hóa.

Sử dụng dịch vụ AI Gateway của bên thứ ba:

- Ưu điểm: Triển khai nhanh chóng, giảm gánh nặng phát triển và bảo trì. Thường đi kèm với các tính năng nâng cao như quản lý API key, rate limiting, caching, và phân tích hiệu suất ngay lập tức.

- Nhược điểm: Phụ thuộc vào nhà cung cấp dịch vụ, có thể bị giới hạn về khả năng tùy chỉnh. Rủi ro về khóa nhà cung cấp (vendor lock-in) và chi phí có thể tăng theo mức độ sử dụng. Vấn đề bảo mật dữ liệu và quyền riêng tư cần được xem xét cẩn thận khi dữ liệu đi qua một bên thứ ba.

Kết hợp Hybrid: Một số doanh nghiệp lựa chọn phương pháp kết hợp, xây dựng một Gateway cơ bản tự host để quản lý các tính năng cốt lõi và bảo mật, đồng thời tích hợp với các dịch vụ bên thứ ba cho các tính năng chuyên biệt hoặc để tận dụng các mô hình AI độc quyền. Cách tiếp cận này mang lại sự cân bằng giữa kiểm soát và hiệu quả.

Các Lưu Ý Quan Trọng khi triển khai AI Gateway

- Bảo mật là ưu tiên hàng đầu: Đảm bảo rằng tất cả các khóa API của nhà cung cấp AI được lưu trữ an toàn (ví dụ: trong biến môi trường hoặc Secret Manager) và không bao giờ được hardcode. Áp dụng xác thực mạnh mẽ cho Gateway API của bạn (ví dụ: JWT, OAuth2).

- Thiết kế API chuẩn hóa: Đầu tư thời gian vào việc thiết kế một giao diện API nhất quán và dễ sử dụng cho Gateway của bạn. Điều này sẽ giúp các nhà phát triển client dễ dàng tích hợp và giảm thiểu lỗi.

- Xử lý lỗi mạnh mẽ: Triển khai các cơ chế xử lý lỗi chi tiết, bao gồm mã lỗi chuẩn hóa, thông báo lỗi rõ ràng và khả năng ghi log đầy đủ để dễ dàng gỡ lỗi.

- Khả năng mở rộng: Thiết kế Gateway để dễ dàng thêm các nhà cung cấp AI mới mà không cần thay đổi lớn về kiến trúc. Sử dụng kiến trúc module cho các adapter.

- Giám sát và cảnh báo: Thiết lập hệ thống giám sát toàn diện để theo dõi hiệu suất, độ trễ, tỷ lệ lỗi và chi phí của Gateway. Cảnh báo tự động khi có vấn đề xảy ra.

- Tối ưu hóa chi phí: Khám phá các chiến lược như caching, chọn mô hình AI phù hợp nhất cho từng tác vụ (ví dụ: mô hình nhỏ hơn cho các tác vụ đơn giản), và sử dụng cơ chế failover để chuyển đổi sang nhà cung cấp rẻ hơn khi khả dụng.

- Quản lý phiên bản (Versioning): Giống như bất kỳ API nào, việc quản lý phiên bản cho AI Gateway API là rất quan trọng để đảm bảo khả năng tương thích ngược khi bạn thêm tính năng mới hoặc thay đổi cấu trúc.

Câu Hỏi Thường Gặp

Tại sao tôi không nên gọi trực tiếp API của nhà cung cấp AI?

Gọi trực tiếp API của nhà cung cấp AI có thể dẫn đến sự phức tạp trong việc quản lý nhiều API khác nhau, khó khăn khi chuyển đổi nhà cung cấp, thiếu cơ chế retry/failover tập trung, và rủi ro bảo mật nếu các khóa API bị lộ trên client-side. AI Gateway giúp giải quyết những vấn đề này bằng cách cung cấp một lớp trừu tượng và quản lý tập trung.

AI Gateway có làm tăng độ trễ (latency) không?

Có, việc thêm một lớp trung gian như AI Gateway chắc chắn sẽ làm tăng một chút độ trễ do yêu cầu phải đi qua một bước xử lý bổ sung. Tuy nhiên, độ trễ này thường là không đáng kể so với lợi ích mà nó mang lại, đặc biệt nếu Gateway được triển khai gần với ứng dụng client hoặc nhà cung cấp AI. Hơn nữa, các tính năng như caching có thể thực sự giảm độ trễ cho các yêu cầu lặp lại.

Làm thế nào để chọn nhà cung cấp AI phù hợp thông qua Gateway?

Bạn có thể chọn nhà cung cấp AI dựa trên nhiều tiêu chí: hiệu suất (tốc độ, chất lượng), chi phí, khả năng sẵn sàng, hoặc các tính năng đặc thù. Trong payload gửi đến Gateway, bạn có thể chỉ định nhà cung cấp mong muốn. Một Gateway nâng cao có thể tự động chọn nhà cung cấp tối ưu dựa trên thuật toán cân bằng tải hoặc chính sách đã định cấu hình (ví dụ: ưu tiên nhà cung cấp rẻ nhất hoặc nhanh nhất).

AI Gateway có hỗ trợ các mô hình AI tự host (on-premise) không?

Hoàn toàn có thể. Một AI Gateway được thiết kế linh hoạt có thể dễ dàng tích hợp các mô hình AI tự host thông qua việc tạo một adapter tùy chỉnh cho API của mô hình đó. Điều này cho phép bạn quản lý cả các mô hình công cộng và riêng tư dưới một giao diện thống nhất.

Kết Luận

Xây dựng một AI Gateway API đa kênh không chỉ là một giải pháp kỹ thuật mà còn là một chiến lược kinh doanh thông minh trong bối cảnh AI đang phát triển nhanh chóng. Nó cho phép các tổ chức như vibe coding duy trì sự linh hoạt, tối ưu hóa chi phí, tăng cường bảo mật và đẩy nhanh tốc độ phát triển các dự án AI. Bằng cách trừu tượng hóa sự phức tạp của việc tích hợp nhiều nhà cung cấp AI, chúng ta có thể tập trung vào việc tạo ra giá trị cốt lõi cho người dùng.

Hy vọng rằng bài viết này đã cung cấp cho bạn cái nhìn sâu sắc về tầm quan trọng và cách thức triển khai một AI Gateway hiệu quả. Đây là một công cụ không thể thiếu để xây dựng các ứng dụng AI mạnh mẽ, bền vững và sẵn sàng cho tương lai. Hãy tiếp tục theo dõi vibe coding để khám phá thêm nhiều kiến thức và giải pháp công nghệ tiên tiến khác!