Giới Thiệu Xây Dựng AI Agent "Hybrid" Với Retrieval Augmented Generation (RAG) & Tool Use: Nâng Tầm AI Coding

Chào mừng các bạn đến với một chủ đề nóng hổi và đầy tiềm năng trong thế giới AI: việc xây dựng các AI Agent thông minh hơn, có khả năng tương tác và giải quyết vấn đề phức tạp. Trong bài viết chuyên sâu này, chúng ta sẽ cùng nhau khám phá cách kết hợp hai kỹ thuật mạnh mẽ là Retrieval Augmented Generation (RAG) và Tool Use để tạo ra các AI Agent "Hybrid" thực sự đột phá. Bài viết về RAG Tool Use này sẽ giúp bạn hiểu rõ từ góc nhìn thực tế, cách chúng ta có thể nâng tầm khả năng lập trình AI, vượt qua giới hạn của các mô hình ngôn ngữ lớn (LLMs) truyền thống và mở ra kỷ nguyên mới cho AI Coding.

RAG & Tool Use: Hai Mảnh Ghép Hoàn Hảo Cho AI Agent

Để xây dựng một AI Agent thực sự hữu ích và đáng tin cậy, đặc biệt trong lĩnh vực coding, chúng ta không thể chỉ dựa vào kiến thức cố định mà LLM được huấn luyện. LLMs có thể "ảo giác" (hallucinate), thiếu thông tin cập nhật, hoặc không có khả năng tương tác với môi trường bên ngoài. Đây chính là lúc RAG và Tool Use phát huy sức mạnh của mình.

Retrieval Augmented Generation (RAG): Kiến Thức Luôn Sẵn Sàng

RAG là một kiến trúc cho phép LLM truy xuất thông tin từ một cơ sở dữ liệu bên ngoài (knowledge base) trước khi tạo ra phản hồi. Thay vì chỉ dựa vào những gì đã được học trong quá trình huấn luyện, RAG cho phép AI Agent "tra cứu" thông tin thực tế, cập nhật và chuyên biệt. Điều này đặc biệt quan trọng trong coding, nơi cú pháp, API, thư viện và framework liên tục thay đổi. Ví dụ, một AI Agent được trang bị RAG có thể truy vấn tài liệu kỹ thuật của một thư viện cụ thể, đọc các ví dụ code từ GitHub, hoặc tìm kiếm giải pháp cho một lỗi compiler mà nó chưa từng gặp trực tiếp.

Quy trình RAG thường bao gồm các bước sau:

- Indexing (Lập chỉ mục): Các tài liệu (documentation, code snippets, bài viết) được chia thành các đoạn nhỏ (chunks) và nhúng vào không gian vector bằng một mô hình nhúng (embedding model). Các vector này được lưu trữ trong một vector database.

- Retrieval (Truy xuất): Khi người dùng đưa ra câu hỏi, câu hỏi đó cũng được nhúng thành vector. Vector này sau đó được sử dụng để tìm kiếm các đoạn tài liệu có liên quan nhất trong vector database.

- Augmentation (Bổ sung): Các đoạn tài liệu được truy xuất sẽ được đưa vào làm ngữ cảnh (context) cho LLM cùng với câu hỏi ban đầu.

- Generation (Tạo sinh): LLM sử dụng ngữ cảnh bổ sung này để tạo ra câu trả lời chính xác và phù hợp hơn.

Tool Use (Sử Dụng Công Cụ): Hành Động & Tương Tác

Tool Use, hay còn gọi là Function Calling, là khả năng của AI Agent phát hiện khi nào cần sử dụng một công cụ bên ngoài để hoàn thành một nhiệm vụ và sau đó thực hiện việc đó. Các công cụ này có thể là API, cơ sở dữ liệu, trình biên dịch code, trình duyệt web, hoặc bất kỳ hệ thống nào mà AI Agent có thể tương tác. Trong bối cảnh AI Coding, Tool Use là cực kỳ quan trọng vì nó cho phép Agent:

- Thực thi code để kiểm tra lỗi hoặc chạy test cases.

- Tìm kiếm trên web để cập nhật thông tin hoặc debug.

- Tương tác với hệ thống quản lý phiên bản (Git) để commit code.

- Gọi các API của các dịch vụ đám mây (AWS, GCP, Azure) để triển khai ứng dụng.

- Sử dụng trình phân tích tĩnh (static analyzer) để kiểm tra chất lượng code.

Tool Use biến AI Agent từ một "người kể chuyện" thành một "người thực hiện". Nó không chỉ trả lời câu hỏi mà còn có thể thực hiện hành động dựa trên yêu cầu, mang lại giá trị thực tế cao hơn rất nhiều.

Xây Dựng AI Agent "Hybrid": Kết Hợp Sức Mạnh

AI Agent "Hybrid" là sự kết hợp thông minh giữa RAG và Tool Use. Agent này không chỉ có khả năng truy xuất thông tin chính xác mà còn có thể sử dụng các công cụ để giải quyết vấn đề. Hãy tưởng tượng một kịch bản: một lập trình viên yêu cầu AI Agent xây dựng một hàm Python để tính toán lãi suất kép.

- RAG: Agent đầu tiên có thể sử dụng RAG để truy xuất các công thức tính lãi suất kép, các hàm toán học liên quan trong Python từ tài liệu hoặc các ví dụ code.

- Tool Use: Sau khi có đủ thông tin, Agent sẽ viết code. Sau đó, nó sử dụng một công cụ (ví dụ: một trình thông dịch Python) để chạy code, kiểm tra kết quả với các trường hợp thử nghiệm đã biết. Nếu có lỗi, nó lại dùng RAG để tìm kiếm giải pháp cho lỗi đó, sửa code và lặp lại quá trình kiểm tra.

Hướng Dẫn Thực Hành: Xây Dựng Một AI Agent Coding Đơn Giản

Để minh họa, chúng ta sẽ xây dựng một AI Agent đơn giản có khả năng:

- Truy vấn tài liệu Python (RAG).

- Thực thi code Python (Tool Use).

Bước 1: Chuẩn Bị Môi Trường

Đảm bảo bạn đã cài đặt các thư viện cần thiết:

pip install langchain langchain-openai faiss-cpu tiktoken python-dotenvBạn cũng cần có OpenAI API Key. Lưu nó vào file .env:

OPENAI_API_KEY="YOUR_API_KEY"Bước 2: Xây Dựng Cơ Sở Dữ Liệu RAG (Đơn giản)

Chúng ta sẽ tạo một cơ sở dữ liệu nhỏ từ một tài liệu Python giả định. Trong thực tế, bạn sẽ tải tài liệu từ nhiều nguồn hơn.

from langchain_community.document_loaders import TextLoader

from langchain_community.vectorstores import FAISS

from langchain_openai import OpenAIEmbeddings

from langchain_text_splitters import CharacterTextSplitter

import os

from dotenv import load_dotenv

load_dotenv()

# Tạo một file tài liệu giả định

with open("python_docs.txt", "w") as f:

f.write("Python standard library documentation:\n")

f.write("The `math` module provides mathematical functions. E.g., `math.sqrt(x)` returns the square root of x.\n")

f.write("The `os` module provides a way of using operating system dependent functionality. E.g., `os.getcwd()` returns the current working directory.\n")

f.write("List comprehensions provide a concise way to create lists. Example: `[x*2 for x in range(5)]`.\n")

f.write("Dictionaries are unordered collections of key-value pairs. Example: `{'name': 'Alice', 'age': 30}`.\n")

f.write("Functions are defined using the `def` keyword. Example: `def greet(name): return f'Hello, {name}!'`.\n")

# Tải tài liệu

loader = TextLoader("python_docs.txt")

documents = loader.load()

# Chia nhỏ tài liệu

text_splitter = CharacterTextSplitter(chunk_size=1000, chunk_overlap=0)

docs = text_splitter.split_documents(documents)

# Tạo vector store

embeddings = OpenAIEmbeddings()

vectorstore = FAISS.from_documents(docs, embeddings)

# Tạo retriever

retriever = vectorstore.as_retriever()

print("RAG knowledge base created successfully.")

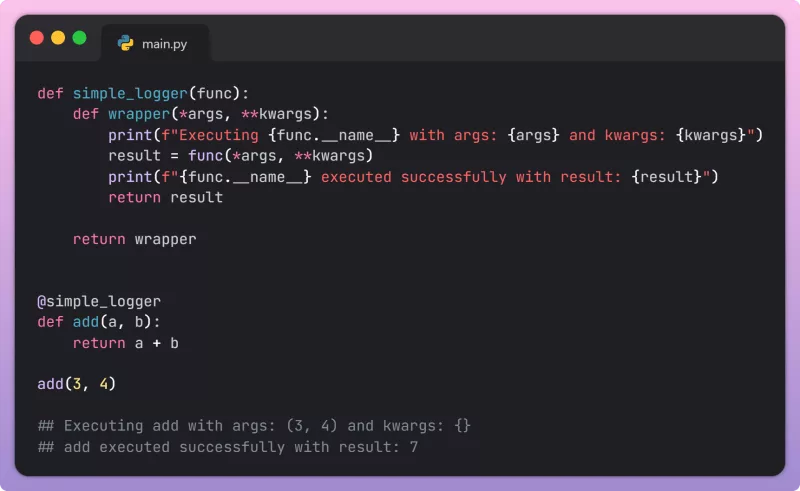

Bước 3: Định Nghĩa Công Cụ (Tool)

Chúng ta sẽ tạo một công cụ để thực thi code Python. LangChain giúp việc này rất dễ dàng.

from langchain.tools import tool

@tool

def python_executor(code: str) -> str:

"""Executes Python code and returns the output.

Takes a string of Python code as input."""

try:

# Chạy code trong một môi trường an toàn hơn (sandbox) nếu có thể

# Để đơn giản, ở đây ta dùng exec. Cần cẩn trọng khi dùng exec trong môi trường production.

global_vars = {}

local_vars = {}

exec_output = io.StringIO()

import sys

sys.stdout = exec_output

exec(code, global_vars, local_vars)

sys.stdout = sys.__stdout__ # Khôi phục stdout

return exec_output.getvalue()

except Exception as e:

return f"Error executing code: {e}"

# Thêm import io cần thiết ở đầu file nếu chưa có

import io

Bước 4: Xây Dựng AI Agent "Hybrid"

Bây giờ chúng ta sẽ kết hợp RAG retriever và python_executor tool vào một Agent. Chúng ta sẽ sử dụng create_openai_functions_agent của LangChain vì nó tự động xử lý việc gọi hàm dựa trên khả năng của OpenAI LLM.

from langchain_openai import ChatOpenAI

from langchain.agents import AgentExecutor, create_openai_functions_agent

from langchain_core.prompts import ChatPromptTemplate, MessagesPlaceholder

from langchain_core.messages import AIMessage, HumanMessage

# Khởi tạo LLM

llm = ChatOpenAI(model="gpt-4o", temperature=0) # Sử dụng gpt-4o hoặc gpt-3.5-turbo

# Định nghĩa các công cụ cho agent

tools = [python_executor]

# Thêm retriever như một công cụ truy vấn kiến thức

tools.append(retriever)

# Định nghĩa prompt cho agent

prompt = ChatPromptTemplate.from_messages([

("system", "You are an AI assistant specialized in Python programming. You can answer questions about Python, write Python code, and execute Python code to verify it. Use the 'python_executor' tool to run code and the 'retriever' tool to look up documentation."),

MessagesPlaceholder("chat_history"),

("human", "{input}"),

MessagesPlaceholder("agent_scratchpad"),

])

# Tạo agent

agent = create_openai_functions_agent(llm, tools, prompt)

# Tạo AgentExecutor

agent_executor = AgentExecutor(agent=agent, tools=tools, verbose=True)

# Lịch sử chat (để agent có thể ghi nhớ ngữ cảnh)

chat_history = []

print("AI Agent Hybrid created. Ready to interact!")

# Hàm tương tác với agent

def ask_agent(question: str):

global chat_history

response = agent_executor.invoke({"input": question, "chat_history": chat_history})

chat_history.append(HumanMessage(content=question))

chat_history.append(AIMessage(content=response["output"]))

return response["output"]

# Ví dụ tương tác

print("\n--- Test 1: Hỏi về tài liệu Python (RAG) ---")

result1 = ask_agent("What does the `math` module provide in Python?")

print(f"Agent's response: {result1}")

print("\n--- Test 2: Viết và thực thi code Python (Tool Use) ---")

result2 = ask_agent("Write a Python function to calculate the square of a number and then use it to find the square of 7. Print the result.")

print(f"Agent's response: {result2}")

print("\n--- Test 3: Kết hợp RAG và Tool Use để giải quyết vấn đề ---")

result3 = ask_agent("I need a list comprehension that creates a list of numbers from 0 to 4, each multiplied by 3. Show me the code and the result by executing it.")

print(f"Agent's response: {result3}")

print("\n--- Test 4: Xử lý lỗi (Agent tự sửa lỗi) ---")

# Agent có thể tự sửa lỗi nếu code có vấn đề và nó nhận ra

result4 = ask_agent("Write a python code to print 'hello world' but accidentally misspell print as 'prnt'. Then execute it and fix the error if any.")

print(f"Agent's response: {result4}")

Trong ví dụ trên, khi bạn chạy ask_agent, bạn sẽ thấy trong log của verbose=True rằng Agent quyết định khi nào cần gọi retriever để tìm kiếm thông tin và khi nào cần gọi python_executor để chạy code. Đây chính là sức mạnh của sự kết hợp RAG Tool Use.

Tips & Best Practices Khi Xây Dựng AI Agent "Hybrid"

Việc xây dựng AI Agent hiệu quả đòi hỏi nhiều hơn là chỉ ghép các thành phần lại với nhau. Dưới đây là một số mẹo và thực hành tốt:

- Chất Lượng Dữ Liệu RAG Là Vàng: Dữ liệu bạn cung cấp cho RAG phải chính xác, đầy đủ và được cập nhật. Dữ liệu kém chất lượng sẽ dẫn đến phản hồi kém chất lượng. Hãy đầu tư vào việc thu thập, làm sạch và chuẩn hóa dữ liệu.

- Thiết Kế Công Cụ Thông Minh:

- Mô tả rõ ràng: Mỗi công cụ cần có một mô tả (docstring) rõ ràng về chức năng, các tham số đầu vào và đầu ra. Đây là cách LLM hiểu cách sử dụng công cụ.

- Atomic & Focused: Các công cụ nên thực hiện một tác vụ cụ thể, nhỏ gọn. Tránh tạo ra các công cụ quá phức tạp hoặc đa chức năng.

- Xử lý lỗi mạnh mẽ: Các công cụ cần có khả năng xử lý lỗi nội bộ và trả về thông báo lỗi hữu ích cho Agent.

- Sandbox cho code execution: Đặc biệt với công cụ thực thi code, hãy luôn cân nhắc về bảo mật. Chạy code trong môi trường sandbox an toàn để tránh rủi ro bảo mật.

- Prompt Engineering Cho Agent: Prompt hệ thống của Agent rất quan trọng. Nó định hình vai trò, mục tiêu và cách Agent nên hành xử. Hãy thử nghiệm với các prompt khác nhau để tối ưu hóa hiệu suất. Ví dụ, bạn có thể hướng dẫn Agent "luôn kiểm tra code bằng cách thực thi nó trước khi đưa ra câu trả lời cuối cùng."

- Quản lý Lịch Sử Chat (Memory): Để Agent có thể duy trì ngữ cảnh qua nhiều lượt tương tác, việc quản lý lịch sử chat (memory) là cần thiết. LangChain cung cấp nhiều loại memory khác nhau, hãy chọn loại phù hợp với ứng dụng của bạn.

- Sử Dụng Tracing & Debugging: Các thư viện như LangChain cung cấp công cụ tracing để bạn có thể xem xét "suy nghĩ" của Agent, quá trình nó gọi các công cụ và lý do nó đưa ra quyết định. Điều này cực kỳ hữu ích cho việc debug và tối ưu hóa.

- Iterative Development: Xây dựng AI Agent là một quá trình lặp đi lặp lại. Bắt đầu với một Agent đơn giản, kiểm tra, thu thập phản hồi, và dần dần thêm các khả năng phức tạp hơn.

So Sánh & Đánh Giá: RAG Tool Use vs. Các Phương Pháp Khác

Để hiểu rõ hơn giá trị của RAG Tool Use, hãy so sánh nó với các phương pháp xây dựng AI Agent khác:

1. LLM Độc Lập (Vanilla LLM):

- Ưu điểm: Đơn giản nhất, không cần hạ tầng phức tạp.

- Nhược điểm: Dễ bị "ảo giác", kiến thức giới hạn đến thời điểm huấn luyện, không thể tương tác với thế giới bên ngoài, không thể thực thi hành động. Không phù hợp cho các tác vụ coding đòi hỏi độ chính xác và tương tác cao.

2. Fine-tuning LLM:

- Ưu điểm: Có thể chuyên biệt hóa LLM cho một domain cụ thể, cải thiện hiệu suất cho các tác vụ đặc thù nếu có đủ dữ liệu chất lượng cao.

- Nhược điểm: Tốn kém về tài nguyên và thời gian, khó cập nhật kiến thức liên tục, vẫn không giải quyết được vấn đề tương tác với môi trường bên ngoài hoặc thực thi code. Vẫn có thể "ảo giác" với thông tin mới.

3. RAG Độc Lập:

- Ưu điểm: Cung cấp kiến thức cập nhật, giảm "ảo giác", rất tốt cho các tác vụ hỏi đáp thông tin.

- Nhược điểm: Vẫn chỉ là một "người kể chuyện", không thể thực hiện hành động, thực thi code, hoặc tương tác với hệ thống bên ngoài.

4. Tool Use Độc Lập:

- Ưu điểm: Cho phép Agent thực hiện hành động, tương tác với môi trường, rất tốt cho các tác vụ giải quyết vấn đề.

- Nhược điểm: Nếu không có RAG, Agent vẫn chỉ dựa vào kiến thức nội tại của LLM, có thể thiếu thông tin hoặc tạo ra các bước hành động không tối ưu nếu không có ngữ cảnh đầy đủ.

5. RAG Tool Use (Hybrid Agent):

- Ưu điểm: Kết hợp tốt nhất của cả hai thế giới. Vừa có kiến thức cập nhật, chính xác (nhờ RAG), vừa có khả năng thực thi hành động, tương tác với môi trường (nhờ Tool Use). Giảm thiểu "ảo giác", tăng độ tin cậy và khả năng giải quyết vấn đề phức tạp. Lý tưởng cho các AI Agent Coding, nơi cần cả kiến thức và khả năng thực thi.

- Nhược điểm: Phức tạp hơn trong việc triển khai và quản lý, yêu cầu thiết kế hệ thống cẩn thận cho cả RAG và các công cụ.

Rõ ràng, đối với các ứng dụng AI Agent Coding đòi hỏi sự chính xác, khả năng cập nhật và tương tác, mô hình "Hybrid" RAG Tool Use mang lại lợi thế vượt trội. Nó cho phép AI Agent không chỉ "biết" mà còn "làm", biến chúng thành những trợ lý lập trình mạnh mẽ và đáng tin cậy.

Các Lưu Ý Quan Trọng

- Bảo mật: Khi cho phép AI Agent thực thi code, luôn luôn ưu tiên bảo mật. Sử dụng môi trường sandbox, giới hạn quyền truy cập, và kiểm tra kỹ lưỡng mọi kịch bản. Code do AI tạo ra có thể chứa lỗ hổng hoặc hành vi không mong muốn.

- Chi phí: Việc sử dụng LLM, đặc biệt là các mô hình mạnh như GPT-4o, có thể tốn kém. RAG và Tool Use có thể tăng số lượng token được sử dụng (do context dài hơn, nhiều lượt gọi API hơn). Cần tối ưu hóa prompt, kích thước chunk RAG và số lượng lượt tương tác để quản lý chi phí.

- Độ trễ (Latency): Việc gọi các công cụ bên ngoài, truy vấn vector database có thể làm tăng độ trễ của Agent. Cần tối ưu hóa hiệu suất của các công cụ và cơ sở dữ liệu RAG.

- Khả năng giải thích (Explainability): Đôi khi Agent có thể đưa ra một giải pháp đúng nhưng khó hiểu được "lý do" đằng sau. Việc tracing và verbose logging giúp ích rất nhiều trong việc hiểu luồng suy nghĩ của Agent.

- Thiết kế Prompt: Prompt đóng vai trò cực kỳ quan trọng trong việc định hướng hành vi của Agent. Một prompt rõ ràng, chi tiết sẽ giúp Agent đưa ra các quyết định tốt hơn về việc khi nào và làm thế nào để sử dụng các công cụ và RAG.

- Quản lý phiên bản cho Knowledge Base: Nếu tài liệu RAG của bạn thay đổi thường xuyên, hãy có một quy trình để cập nhật và lập chỉ mục lại vector database một cách định kỳ.

Câu Hỏi Thường Gặp

RAG Tool Use có phù hợp cho mọi loại AI Agent không?

Không hẳn. Đối với các tác vụ đơn giản, chỉ cần phản hồi dựa trên kiến thức nội tại của LLM, RAG Tool Use có thể là quá mức cần thiết. Tuy nhiên, với các Agent cần tương tác với thế giới thực, truy xuất thông tin cập nhật hoặc thực hiện hành động, RAG Tool Use là một lựa chọn tuyệt vời.

Làm thế nào để chọn công cụ phù hợp cho AI Agent của tôi?

Hãy bắt đầu bằng cách xác định các hành động mà Agent cần thực hiện để hoàn thành mục tiêu. Mỗi hành động đó có thể trở thành một công cụ. Ví dụ, nếu Agent cần đọc file, tạo công cụ đọc file. Nếu cần truy vấn API, tạo công cụ gọi API đó. Đừng quên các công cụ cơ bản như tìm kiếm web hoặc thực thi code nếu cần.

Có cần phải sử dụng LangChain để xây dựng AI Agent Hybrid không?

Không bắt buộc. LangChain là một framework rất hữu ích giúp đơn giản hóa quá trình này, nhưng bạn hoàn toàn có thể xây dựng Agent Hybrid từ đầu bằng cách tự quản lý các lượt gọi LLM, xử lý Tool Use và tích hợp RAG. Tuy nhiên, các thư viện như LangChain, LlamaIndex giúp tiết kiệm rất nhiều thời gian và công sức.

Việc sử dụng RAG Tool Use có làm tăng khả năng "ảo giác" của LLM không?

Ngược lại, RAG Tool Use được thiết kế để giảm thiểu "ảo giác". Bằng cách cung cấp ngữ cảnh chính xác và cập nhật từ cơ sở dữ liệu RAG, và cho phép Agent kiểm tra thông tin hoặc kết quả thông qua các công cụ, khả năng LLM tạo ra thông tin sai lệch sẽ giảm đáng kể.

Kết Luận

Việc xây dựng AI Agent "Hybrid" với Retrieval Augmented Generation (RAG) và Tool Use đại diện cho một bước tiến lớn trong lĩnh vực AI, đặc biệt là AI Coding. Bằng cách trang bị cho các mô hình ngôn ngữ lớn khả năng truy xuất kiến thức bên ngoài và thực hiện hành động thông qua các công cụ, chúng ta không chỉ khắc phục được những hạn chế cố hữu của LLMs mà còn mở ra vô số khả năng mới cho các ứng dụng thông minh.

Từ việc tự động gỡ lỗi code, tạo các đoạn mã phức tạp dựa trên tài liệu, đến việc tương tác với các hệ thống DevOps, AI Agent "Hybrid" hứa hẹn sẽ trở thành những trợ lý đắc lực, nâng cao năng suất và chất lượng công việc của lập trình viên. Hành trình này đòi hỏi sự hiểu biết sâu sắc về cả RAG và Tool Use, cùng với kỹ năng thiết kế và tối ưu hóa Agent. Hãy tiếp tục khám phá và xây dựng những giải pháp đột phá cùng vibe coding!